GUP 并不是一个像麒麟芯片、鸿蒙系统那样广为人知的独立技术品牌或产品,它是一个技术术语,主要出现在华为的昇腾计算平台和相关的AI计算解决方案中。

GUP的全称是“Graph Unit Processing”,即“图形单元处理”,它是一个专门为处理特定类型计算任务而设计的硬件加速单元。

下面我将从几个方面为您详细解释:

GUP 的核心定位:AI计算的“特种兵”

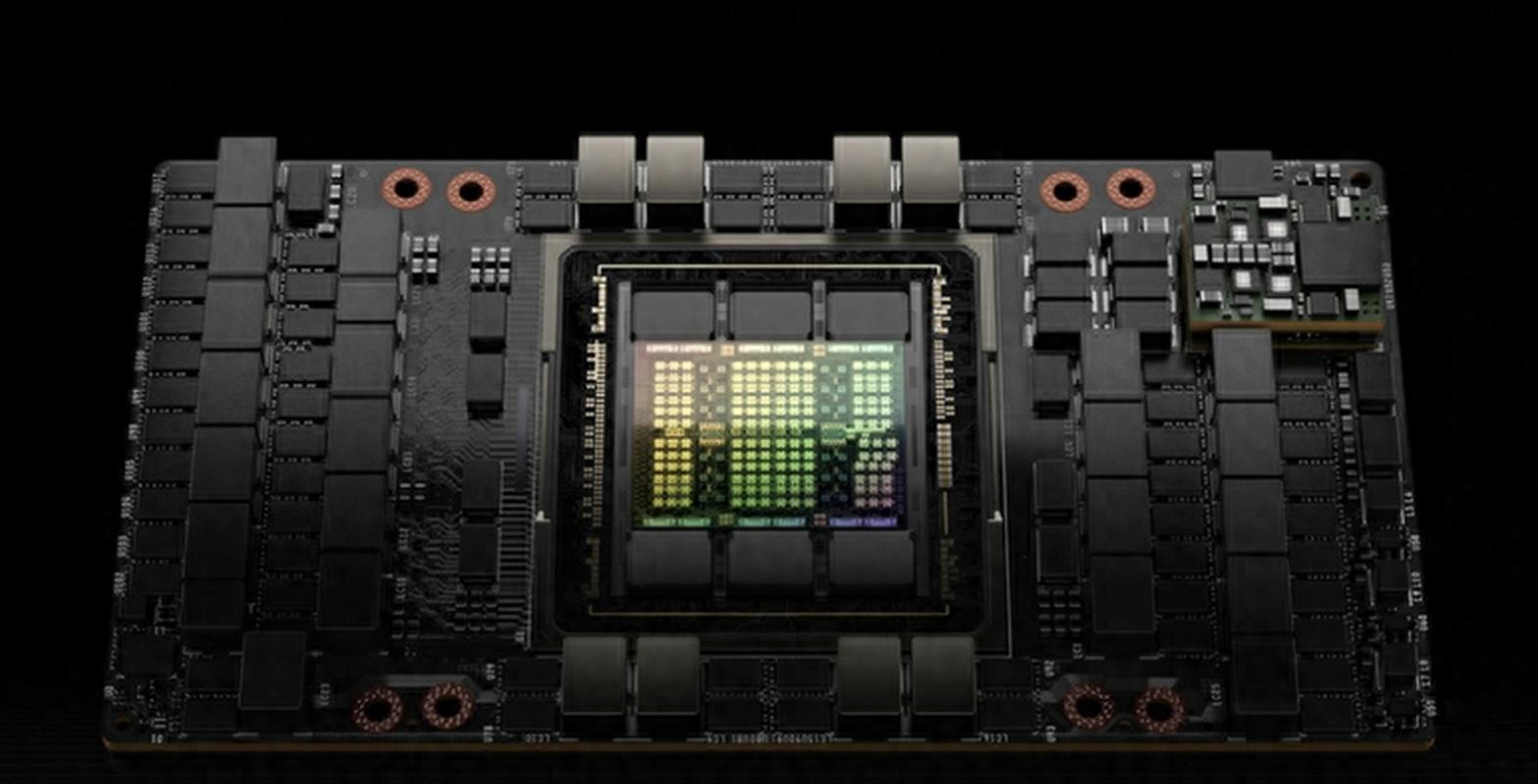

为了理解GUP,我们需要先了解它所在的大背景——昇腾AI处理器。

昇腾AI处理器(如Ascend 310, Ascend 910等)采用的是华为自研的“达芬奇架构”(Da Vinci Architecture),这个架构里不仅仅有我们熟知的AI Core(负责通用AI矩阵运算),还包含多种不同功能的专用硬件单元,形成一个高效的计算集群。

GUP就是这个集群中的一员,它是一个专门用于处理“图”计算任务的硬件加速器。

GUP 解决的核心问题:什么是“图”计算?

“图”是数据结构的一种,由“节点”(Node)和“边”(Edge)组成,它非常适合用来描述和解决那些具有复杂关联关系的问题。

- 生活中的例子:

- 社交网络:每个人是一个节点,好友关系是边。

- 电商推荐系统:商品是节点,共同购买关系是边。

- 金融风控:账户或设备是节点,资金流转关系是边。

- 知识图谱:实体是节点,实体间的关系是边。

传统的CPU或通用GPU在处理这类问题时,效率不高,因为它们的设计更擅长做大规模的、规则的并行计算(如图像矩阵乘法),而不是在复杂的、非结构化的“图”结构上进行遍历、搜索和更新。

GUP的出现,就是为了解决这个痛点。

GUP 的工作原理和优势

GUP硬件内部集成了专门为图计算优化的功能:

- 高效的图遍历:能够快速地在图的节点和边之间跳转,执行广度优先搜索、深度优先搜索等算法。

- 内置的原子操作:在多线程同时访问一个节点时,能够高效地处理并发更新,保证数据一致性,这对于图算法至关重要。

- 高带宽内存访问:能够快速访问存储图结构数据的大规模内存,减少数据等待时间。

- 专用指令集:拥有针对图计算核心操作(如邻居聚合、消息传递)的硬件指令,避免用软件去模拟,从而实现数量级的性能提升。

一句话总结GUP的优势: 它将原本需要CPU通过复杂软件逻辑来执行的、低效的图计算任务,卸载到了一个专用硬件上,实现了“专用硬件做专业的事”,从而极大地提升了处理图相关AI任务的性能和效率。

GUP 的典型应用场景

GUP技术主要赋能于需要处理大规模图数据的AI应用,包括但不限于:

- 推荐系统:分析用户和物品之间的复杂关系,进行更精准的个性化推荐。

- 金融风控:实时构建和扫描交易网络,快速发现异常账户、欺诈团伙和洗钱行为。

- 知识图谱推理:在医疗、法律、客服等领域,基于知识图谱进行智能问答和决策支持。

- 药物研发:模拟分子结构图,加速新药的筛选和发现过程。

- 网络安防:分析网络流量图,识别恶意攻击和异常入侵。

在这些场景中,GUP都能发挥其“图计算加速器”的核心价值。

GUP 与其他单元的协同工作

在昇腾处理器中,GUP并不是孤军奋战,它与AI Core(负责主流AI计算,如CNN、RNN)、Vector Unit(负责向量计算)等其他单元协同工作,形成一个强大的异构计算系统。

- AI Core 负责模型中大部分的矩阵乘法和卷积运算。

- GUP 负责模型中图神经网络部分的计算。

- Vector Unit 负责其他向量和标量运算。

这种分工合作的模式,使得昇腾处理器能够高效地执行复杂的混合计算任务,比如一个既包含传统卷积层又包含图神经网络的AI模型。

| 特性 | 描述 |

|---|---|

| 全称 | Graph Unit Processing (图形单元处理) |

| 所属平台 | 华为昇腾AI计算平台 |

| 本质 | 一个硬件加速单元,专门用于处理图计算任务。 |

| 解决的问题 | 传统CPU/GPU在处理复杂、非结构化“图”数据(如社交网络、知识图谱)时的效率瓶颈。 |

| 核心优势 | 通过专用硬件指令和架构,实现图遍历、邻居聚合等操作的硬件级加速,性能远超通用处理器。 |

| 典型应用 | 推荐系统、金融风控、知识图谱、药物研发等。 |

| 定位 | 华为“达芬奇架构”异构计算体系中的关键一员,与AI Core等单元协同工作。 |

GUP是华为在AI计算领域“软硬协同”战略下的一个具体技术体现,它通过硬件创新来解决特定AI场景的计算瓶颈,是华为构建强大AI算力生态的重要一环,虽然它不像手机芯片那样广为人知,但在企业级AI、数据中心等高性能计算领域,它扮演着至关重要的角色。