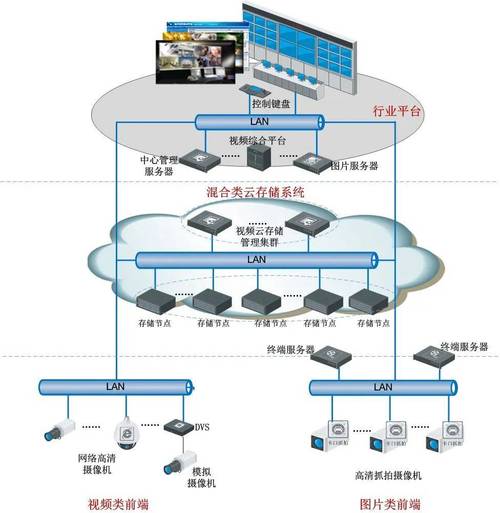

智能视频监控技术研究是当前人工智能与计算机视觉领域的重要方向,其核心在于通过智能化手段提升视频监控系统的分析能力、处理效率和实用价值,随着安防需求的升级和技术的进步,传统视频监控已从被动记录向主动预警、智能决策转变,成为智慧城市、公共安全、工业生产等场景的关键技术支撑。

智能视频监控的核心技术体系

智能视频监控技术的实现依赖于多学科技术的融合,主要包括以下几个层面:

-

视频采集与预处理技术

高清摄像头、红外摄像头、无人机搭载设备等构成视频采集的基础硬件,预处理环节则涉及去噪、增强、稳定化等操作,例如通过高动态范围成像(HDR)解决光照不均问题,利用视频防抖算法提升画面稳定性,为后续分析提供高质量数据源。 -

目标检测与跟踪算法

目标检测是智能监控的基础,传统方法如帧间差分、背景减除等易受环境干扰,而基于深度学习的算法(如YOLO、Faster R-CNN)通过卷积神经网络(CNN)实现复杂场景下的多目标检测,目标跟踪则通过关联算法(如卡尔曼滤波、SORT、DeepSORT)实现运动目标的持续定位,解决目标遮挡、身份切换等问题,在交通监控中,可实时跟踪车辆行驶轨迹并识别交通违法行为。 -

行为分析与事件识别

行为分析技术通过时空特征提取判断目标行为是否异常,传统方法依赖手工提取特征,而基于3D卷积神经网络(如C3D、I3D)的算法可直接从视频序列中学习时空动态特征,实现打架、跌倒、入侵等异常行为的自动识别,在工业场景中,可分析工人操作流程是否符合规范,预防安全事故。 (图片来源网络,侵删)

(图片来源网络,侵删) -

图像识别与语义理解

图像识别技术包括人脸识别、车辆识别、物品识别等,通过预训练模型(如ResNet、ViT)提取特征,结合分类器实现目标分类,语义理解则进一步通过自然语言处理(NLP)与视觉语言模型(如ViLBERT)将图像内容转化为结构化信息,例如将监控画面描述为“某区域有人员聚集”,便于人机交互。 -

多模态数据融合技术

为提升监控系统的鲁棒性,需融合视频、音频、传感器等多源数据,通过声纹识别与视频画面联动,判断异常声音来源;结合红外热成像与可见光图像,实现全天候目标检测,多模态融合可有效解决单一数据源的局限性,提升复杂场景下的识别准确率。

关键技术应用场景

智能视频监控技术已在多个领域展现出广泛应用价值:

| 应用场景 | 技术功能 | 典型案例 |

|---|---|---|

| 公共安全 | 异常行为检测、人脸识别、人群密度分析 | 城市安防中实时识别嫌疑人、预警大型活动人群踩踏风险 |

| 智能交通 | 车辆跟踪、违章检测、交通流量优化 | 高速公路自动抓拍超速、路口信号灯智能配时 |

| 工业生产 | 设备状态监控、工人操作规范检测、安全生产预警 | 工厂流水线产品缺陷检测、工人未佩戴安全帽自动提醒 |

| 智慧零售 | 顾客行为分析、客流统计、商品货架监控 | 商店顾客动线分析、缺货自动预警 |

| 智慧社区 | 出入口人脸识别、高空抛物监测、消防通道占用检测 | 小区门禁系统联动、异常楼栋行为预警 |

技术挑战与发展趋势

尽管智能视频监控技术取得显著进展,但仍面临以下挑战:

- 复杂环境适应性:雨雪、雾霾等恶劣天气以及光照变化会影响图像质量,需提升算法的鲁棒性;

- 实时性与算力需求:高清视频数据处理对计算资源消耗大,边缘计算与模型轻量化(如知识蒸馏、量化压缩)是重要方向;

- 隐私保护问题:监控数据涉及个人隐私,需结合联邦学习、差分隐私等技术实现数据安全利用;

- 多目标关联与长期跟踪:密集场景下目标遮挡、交叉运动等问题仍需优化算法。

未来发展趋势包括:

- AI大模型应用:基于视觉大模型(如ViT、GPT-4)实现更精准的场景理解与语义生成;

- 数字孪生融合:构建虚拟监控场景,实现物理世界与数字世界的实时交互;

- 主动防御系统:从被动监控转向主动预警,例如通过预测目标运动轨迹提前干预风险事件。

相关问答FAQs

Q1:智能视频监控系统与传统监控系统的主要区别是什么?

A1:传统监控系统主要依赖人工查看录像,功能局限于视频录制与存储,实时性差且分析能力弱;而智能视频监控系统通过AI算法实现自动检测、识别、预警和数据分析,可实时处理视频内容并生成结构化信息,大幅提升监控效率,减少人工依赖,适用于大规模、复杂场景的智能化管理。

Q2:如何解决智能视频监控中的隐私保护问题?

A2:隐私保护可通过技术与管理手段结合实现:技术上,采用图像脱敏(如人脸模糊、关键区域遮挡)、联邦学习(在本地训练模型而不共享原始数据)、差分隐私(向数据中添加噪声保护个体信息)等方法;管理上,建立数据分级访问制度,明确数据使用范围,并遵守相关法律法规(如《个人信息保护法》),确保监控数据在合法合规的前提下应用。