核心概念:目标检测与跟踪是什么?

我们需要清晰地定义这两个任务以及它们之间的关系。

目标检测

目标:在给定的图像或视频帧中,定位并识别出一个或多个感兴趣的目标。

- 定位:通常通过一个边界框来表示目标的位置,更高级的会使用像素级的分割掩码。

- 识别:判断边界框内目标的类别(人、车、猫、狗等)。

- 输出:一个包含目标类别、位置(通常是边界框坐标

x, y, w, h)和置信度得列表。

简单理解:目标回答的是“在哪里?是什么?”的问题。

目标跟踪

目标:在视频序列中,为指定的一个或多个目标建立一个持续的、一致的标识,并在每一帧中确定其位置。

- 初始化:通常由目标检测提供第一帧中目标的初始位置。

- 关联:在后续帧中,将检测到的候选框与上一帧的目标进行匹配,确定“谁是谁”。

- 状态估计:预测目标在下一帧可能出现的位置,并平滑其运动轨迹。

- 输出:一个或多个目标在每一帧中的持续身份标识和位置。

简单理解:目标跟踪回答的是“目标A去哪里了?”的问题,它关注的是目标的身份恒常性。

两者的关系:检测与跟踪

在实际应用中,目标检测和跟踪通常是紧密耦合、协同工作的。

-

“检测-跟踪”范式:这是最经典和主流的范式。

- 检测:在每一帧图像上运行目标检测器,找出所有目标。

- 跟踪:使用跟踪算法(如卡尔曼滤波、匈牙利算法等)将当前帧检测到的目标与上一帧已跟踪的目标进行关联,并更新它们的状态。

- 新目标/消失目标处理:如果一个检测框无法与任何已有目标关联,则认为是新目标,为其分配新ID,如果一个目标连续多帧未出现,则认为其已离开,从跟踪列表中移除。

-

“跟踪-检测”范式:一些高级算法(如SiamMask, FairMOT)会先进行跟踪,再根据跟踪结果来辅助或指导检测,以提高效率和准确性。

核心技术详解

目标检测技术演进

目标检测技术的发展经历了几个重要阶段:

传统方法

- 代表算法:Viola-Jones (人脸检测)、HOG (方向梯度直方图) + SVM (支持向量机)、DPM (可变形部件模型)。

- 原理:手工设计特征(如HOG特征、Haar特征),然后使用分类器(如SVM、AdaBoost)进行分类。

- 缺点:特征设计依赖专家经验,泛化能力弱,计算效率相对较低,难以应对复杂场景。

两阶段检测器

- 核心思想:先生成可能包含目标的候选区域,然后对这些区域进行分类和位置精修。

- 代表算法:

- R-CNN系列:开创了深度学习目标检测的先河,R-CNN -> SPP-Net -> Fast R-CNN -> Faster R-CNN,Faster R-CNN引入了RPN (Region Proposal Network),实现了端到端的训练,成为两阶段检测的基石。

- Mask R-CNN:在Faster R-CNN基础上增加了实例分割分支,不仅能检测目标,还能画出目标的精确轮廓。

- 优点:精度高,对目标定位准确。

- 缺点:速度相对较慢,不适合实时性要求高的场景。

单阶段检测器

- 核心思想:直接在图像的密集网格上进行预测,省去了候选区域生成步骤,速度更快。

- 代表算法:

- YOLO (You Only Look Once) 系列:将图像划分为网格,每个网格直接预测边界框和类别,从YOLOv1到YOLOv8,不断在速度和精度之间取得平衡,是目前实时检测领域的王者。

- SSD (Single Shot MultiBox Detector):在多个不同尺度的特征图上进行预测,对小目标检测效果较好。

- 优点:速度快,实时性好。

- 缺点:早期版本精度略低于两阶段方法,对小目标检测不敏感。

新兴方法

- DETR (DEtection TRansformer):将目标检测视为一个集合预测问题,使用Transformer替代了NMS(非极大值抑制)等后处理操作,架构新颖,代表了检测技术的未来方向之一。

- Anchor-Free 方法:如 FCOS (Fully Convolutional One-Stage),直接预测目标中心点到边界框四边的距离,避免了锚框的设计和调优,简化了模型。

目标跟踪技术演进

传统方法

- 生成式模型:如卡尔曼滤波、粒子滤波,它们通过建立目标的运动模型来预测下一帧位置,然后在预测位置附近进行模板匹配,优点是简单快速,缺点是容易受背景干扰。

- 判别式模型:如相关滤波,学习一个滤波器,使其能最大化目标区域与模板的响应值,代表性算法有 KCF (Kernelized Correlation Filters),速度快,曾是实时跟踪的标杆。

基于深度学习的跟踪

- 核心思想:利用深度神经网络强大的特征提取能力,学习更鲁棒的目标表示。

- 代表算法:

- Siamese 网络:这是目前主流的跟踪范式,它由两个相同的网络分支(孪生网络)组成,一个分支处理模板(前一帧的目标),另一个分支处理搜索区域(当前帧的候选区域),通过计算两者的相似度来找到目标。SiamFC 是其经典之作。

- SiamRPN / SiamRPN++:将RPN (Region Proposal Network) 引入到Siamese框架中,不仅判断目标是否存在,还直接预测边界框,实现了高精度和高速度的平衡。

- 基于检测的跟踪:在每一帧都运行一个强大的目标检测器(如YOLO),然后使用简单的关联算法(如IOU匹配)来维持目标ID,这种方法简单鲁棒,但计算开销大。

- 基于Transformer的跟踪:借鉴NLP中的Transformer,通过自注意力和交叉注意力机制来建模模板和搜索区域之间的关系,能够捕捉更复杂的上下文信息,代表算法如 TransT, OSTrack,是目前SOTA(State-of-the-Art)水平。

前沿进展与热点方向

-

多目标跟踪:从跟踪单个目标扩展到同时跟踪场景中的所有目标,核心挑战在于数据关联,即如何准确地将不同帧中的同一个目标对应起来。FairMOT, ByteTrack 等算法通过联合优化检测和嵌入特征,实现了高精度的MOT。

-

无检测跟踪:直接在视频流上进行跟踪,跳过独立的检测步骤,旨在实现端到端的、更高效的跟踪,这类方法通常利用时序信息来构建目标的运动和外观模型。

-

3D目标检测与跟踪:将技术从2D图像扩展到3D空间(如自动驾驶中的车辆、行人),不仅能检测目标,还能估计其距离、速度、朝向等信息,通常依赖激光雷达或深度相机数据。

-

视频对象分割:与目标跟踪类似,但要求输出的是像素级的掩码,而不仅仅是边界框。DAVIS, YouTube-VOS 是该领域的代表性数据集和算法。

-

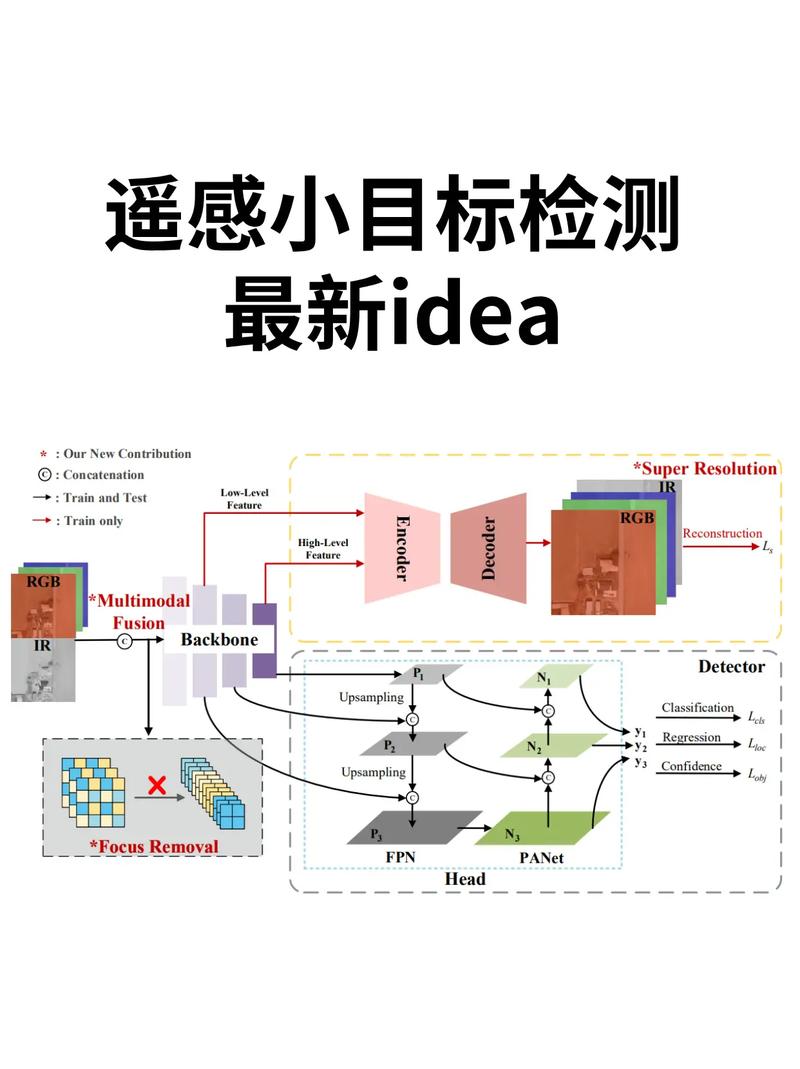

小目标检测与跟踪:在遥感、安防监控等领域,小目标(如远处的行人、无人机)的检测与跟踪极具挑战性,研究重点在于如何增强特征、利用上下文信息、解决样本不均衡问题。

-

模型轻量化与部署:将复杂的检测和跟踪模型部署到边缘设备(如手机、嵌入式摄像头、无人机)上,需要模型轻量化、量化、剪枝等技术。

主要挑战与未来展望

当前挑战

- 极端遮挡与严重形变:当目标被其他物体长时间遮挡或发生剧烈姿态变化时,跟踪器容易丢失目标。

- 快速运动与尺度变化:目标运动过快或相机移动导致的目标模糊,以及目标与相机距离变化引起的尺度剧烈变化,都是巨大挑战。

- 外观相似与身份切换:当场景中存在多个外观相似的目标时,跟踪器容易混淆它们的身份,导致ID切换错误。