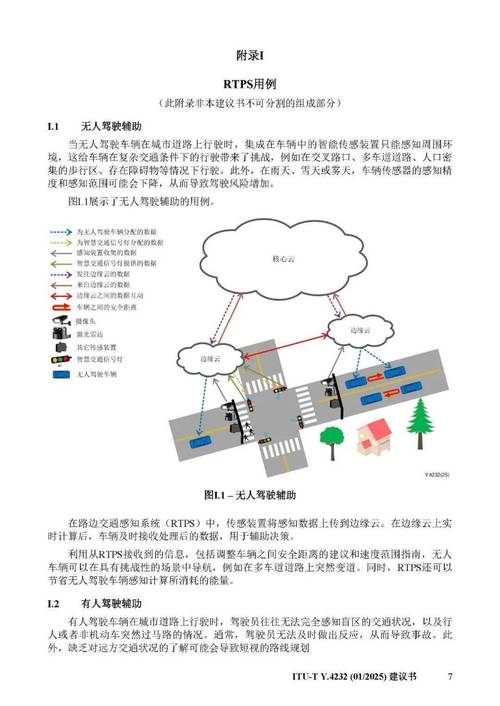

交通感知技术作为智能交通系统的核心组成部分,通过多维度、多手段的感知方式实现对交通环境、车辆状态及行人行为的实时监测与数据采集,为交通管理、出行服务、自动驾驶等领域提供关键支撑,根据感知原理、技术手段和应用场景的不同,交通感知技术主要可分为以下几类,各类技术相互补充、协同工作,构建起全方位的交通感知网络。

基于机器视觉的感知技术

机器视觉技术通过摄像头、激光雷达等光学设备采集交通场景中的图像或点云数据,利用计算机视觉算法实现目标检测、识别、跟踪及行为分析,该技术具有信息丰富、成本相对较低、易于部署等优势,是当前应用最广泛的感知技术之一。

- 摄像头感知:包括可见光摄像头、红外摄像头等,可识别车辆颜色、类型、车牌信息,检测行人、非机动车目标,并通过视频流分析交通流量、平均车速、占有率等参数,基于深度学习的目标检测算法(如YOLO、Faster R-CNN)可实现对道路上多种目标的实时识别,结合跟踪算法(如DeepSORT)可完成车辆轨迹追踪。

- 激光雷达(LiDAR)感知:通过发射激光束并接收反射信号,生成高精度三维点云数据,可精确测量目标物体的距离、形状、位置及姿态,激光雷达不受光照条件影响,在夜间、雨雾等恶劣天气下仍能保持稳定性能,广泛应用于自动驾驶车辆的障碍物检测、环境建模及高精度地图构建,其缺点是成本较高、点云数据处理复杂。

基于无线通信的感知技术

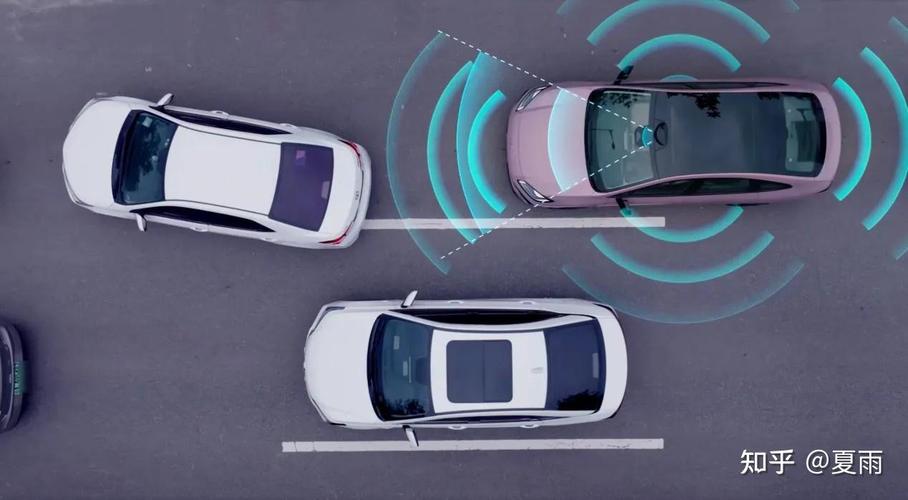

无线通信感知技术利用车辆与基础设施(V2I)、车辆与车辆(V2V)、车辆与行人(V2P)之间的通信,实现交通信息的交互与共享,具有感知范围广、低时延、可穿透遮挡等特点。

- DSRC(专用短程通信):基于IEEE 802.11p标准,工作在5.9GHz频段,通信距离通常为300-1000米,时延低至毫秒级,支持实时交通信号、道路危险状况、车辆速度等信息的广播,适用于交叉路口碰撞预警、不停车收费等场景。

- C-V2X(蜂窝车联网):包括LTE-V2X和5G-V2X,基于蜂窝网络架构,可直接复用现有通信基站,降低部署成本,5G-V2X凭借高带宽、低时延(<20ms)和海量连接能力,支持更复杂的协同驾驶应用,如编队行驶、远程驾驶等,并能与高精度定位、边缘计算技术深度融合,提升感知精度和实时性。

基于定位与导航的感知技术

定位导航技术通过获取车辆或行人的位置信息,实现对交通参与者运动状态的感知,是路径规划、轨迹追踪的基础。

- GPS/北斗定位:通过接收卫星信号实现全球范围内的定位,精度通常为1-5米(民用),结合差分定位(DGPS)或实时动态差分(RTK)技术,精度可提升至厘米级,但GPS信号在隧道、高楼密集区易受遮挡,需与其他定位技术融合使用。

- 惯性导航(INS):通过加速度计、陀螺仪等传感器测量车辆的加速度和角速度,推算位置和姿态信息,具有自主性强、短时精度高的特点,但长期存在累积误差,常与GPS组合使用(GPS/INS组合导航),以提升定位可靠性。

- 航位推算(DR):基于车辆速度、方向盘转角等参数估算行驶距离和方向,成本低但误差随时间累积,适用于隧道、地下车库等卫星信号缺失场景的辅助定位。

基于传感器网络的感知技术

传感器网络通过部署在道路、桥梁、隧道等基础设施中的各类传感器,采集交通流量、速度、 occupancy、气象环境等数据,实现对交通基础设施状态的实时监测。

- 地磁传感器:通过检测车辆通过时引起的地磁场变化,实现车辆存在检测和流量统计,具有安装简便、功耗低、不受天气影响等优点,常用于停车场入口、小区道路等场景。

- 微波雷达:发射微波信号并接收反射回波,可检测车辆速度、距离及流量,作用距离远(可达200米以上),穿透性强,适用于高速公路、城市快速路等大范围交通监测。

- 视频事件检测器:基于图像处理技术,自动检测交通事故、拥堵、违章停车等异常事件,支持7×24小时不间断监测,可替代传统人工巡查,提升交通管理效率。

基于多源数据融合的感知技术

单一感知技术存在局限性(如摄像头受光照影响、激光雷达成本高),多源数据融合通过整合不同传感器、不同来源的数据(如视觉、雷达、GPS、通信数据),利用算法优势互补,提升感知的准确性、鲁棒性和全面性。

- 数据层融合:直接对原始传感器数据(如图像、点云、信号强度)进行融合,保留最多信息量,但对数据同步性和处理能力要求高,如激光雷达点云与图像像素的配准。

- 特征层融合:提取各数据的特征(如车辆位置、形状、速度)后进行融合,减少数据量,适用于实时性要求较高的场景,如基于卡尔曼滤波的多目标跟踪算法。

- 决策层融合:各传感器独立完成目标检测和识别后,对决策结果进行投票或加权融合,容错性强,但精度较低,适用于对安全性要求高的场景(如自动驾驶碰撞预警)。

新兴感知技术

随着技术发展,新型感知手段不断涌现,进一步拓展了交通感知的边界。

- 毫米波雷达:工作在30-300GHz频段,分辨率高、抗干扰能力强,可穿透雾、雨、雪等恶劣天气,适用于车辆盲区监测、自适应巡航等场景,成本低于激光雷达,在高级驾驶辅助系统(ADAS)中应用广泛。

- 声学感知:通过麦克风阵列采集车辆、行人产生的声音信号,利用声源定位技术识别目标位置和类型,适用于夜间或低光照条件下的辅助检测,如行人过街预警。

- 生物感知:通过红外热成像、心率监测等技术检测行人或驾驶员的状态(如疲劳驾驶、突发疾病),提升交通安全性,目前处于实验室验证阶段。

各类交通感知技术对比

| 技术类型 | 优势 | 劣势 | 典型应用场景 |

|---|---|---|---|

| 机器视觉 | 信息丰富、成本低、易于部署 | 受光照、天气影响大,三维感知能力弱 | 交通流量监测、车牌识别、违章检测 |

| 激光雷达 | 高精度三维建模、不受光照影响 | 成本高、点云数据处理复杂 | 自动驾驶环境建模、高精度地图构建 |

| DSRC/C-V2X | 通信范围广、低时延、支持协同 | 依赖通信基础设施,易受电磁干扰 | 交叉路口碰撞预警、V2X信息服务 |

| GPS/北斗定位 | 全球覆盖、高精度(差分后) | 信号易遮挡、隧道内失效 | 车辆导航、轨迹追踪、车队管理 |

| 地磁/微波传感器 | 安装简便、功耗低、抗干扰 | 检测范围有限,功能单一 | 停车场管理、局部路段流量统计 |

| 多源数据融合 | 提升准确性、鲁棒性、全面性 | 算法复杂度高,对数据同步要求严格 | 自动驾驶感知系统、城市交通大脑 |

相关问答FAQs

Q1:为什么自动驾驶车辆需要多种感知技术融合,而非依赖单一传感器?

A1:单一传感器存在固有局限性:摄像头在雨雾、夜间环境下性能下降,激光雷达成本高且点云数据难以识别颜色纹理,GPS在隧道内信号丢失,多传感器融合(如摄像头+激光雷达+毫米波雷达+GPS)可优势互补:激光雷达提供精确三维环境,摄像头识别交通信号灯和车道线,毫米波雷达弥补恶劣天气下的感知缺陷,GPS提供全局位置信息,从而实现全天候、全场景的可靠感知,保障自动驾驶安全性。

**Q2:交通感知技术与“智慧交通”是什么关系?

A2:交通感知技术是智慧交通的“感官系统”,负责实时采集交通参与者、基础设施、环境等全要素数据,为智慧交通的“大脑”(如交通大脑、云控平台)提供决策依据,通过感知技术获取实时交通流量数据后,智慧交通系统可动态优化信号配时、诱导车辆避开拥堵路段;感知技术还可识别交通事故、恶劣天气等突发情况,触发应急响应机制,没有精准的感知,智慧交通的“智能决策”和“高效服务”便无从谈起,二者是基础支撑与上层应用的关系。