图像预处理技术在视频处理领域扮演着至关重要的角色,它是提升视频质量、优化后续分析(如目标检测、行为识别、压缩传输等)的基础环节,视频本质上是由连续的图像帧序列构成,因此图像预处理技术需要针对时间序列特性进行适配,既要处理单帧的空间信息,又要考虑帧间的 temporal 关联性,以下从关键技术、应用场景及挑战等方面展开详细阐述。

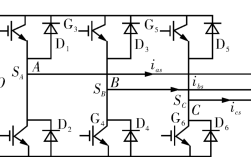

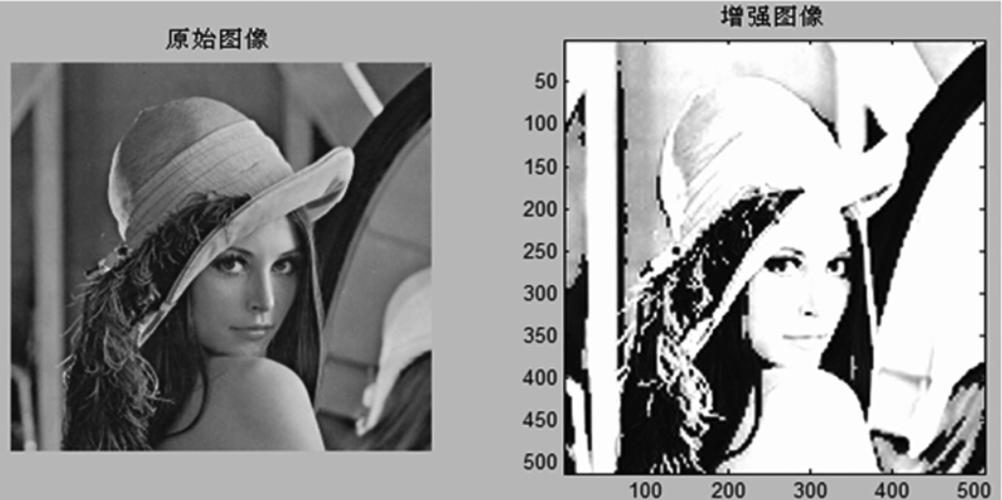

图像预处理技术种类繁多,针对视频的不同需求,可分为空间域处理和时间域处理两大类,空间域预处理主要针对单帧图像,通过像素级操作改善视觉质量或特征提取效果,常见的空间域技术包括灰度化、去噪、增强、几何校正等,灰度化将彩色视频转换为灰度视频,减少计算量,适用于对颜色信息不敏感的任务;去噪则通过高斯滤波、中值滤波或非局部均值等方法抑制图像中的噪声(如高斯噪声、椒盐噪声),提升信噪比;图像增强技术如直方图均衡化可增强图像对比度,使暗部细节更清晰;几何校正则用于消除镜头畸变或拍摄角度导致的图像变形,确保空间一致性,边缘检测(如Canny算子)、色彩空间转换(如RGB转HSV/YCbCr)等也属于空间域预处理,旨在突出特定特征或适配后续算法需求。

时间域预处理则关注视频帧间的关联性,主要用于处理运动模糊、 temporal 噪声及帧间不一致问题,帧间平均法是简单的时间域去噪技术,通过连续多帧像素的平均值抑制随机噪声,但会牺牲运动物体的清晰度;更高级的方法如光流估计,通过计算相邻帧间的像素运动矢量,进行运动补偿去噪或帧插值,提升动态场景的稳定性;对于视频压缩后的压缩伪影(如块效应、振铃效应),时域滤波(如运动自适应滤波)可根据运动强度调整滤波强度,避免在运动区域产生模糊,视频稳定化技术通过估计全局运动矢量并反向补偿,消除手抖等导致的画面抖动,属于重要的时间域预处理。

针对视频分析的特定任务,预处理技术还需结合算法需求进行定制,在目标检测任务中,背景减除(如高斯混合模型、帧间差分法)可分离运动目标与静态背景,预处理阶段的目标是生成精确的掩码;在行为识别中,时空兴趣点(如HOG3D、光流直方图)提取前,需对视频进行光流平滑和尺度归一化,以消除光照变化和拍摄距离的影响,对于深度学习模型,输入视频的归一化(如像素值缩放到[0,1]或标准化)、随机裁剪、翻转等数据增强操作也可视为预处理的一部分,可提升模型泛化能力。

视频预处理技术的应用场景广泛,在视频监控中,预处理可增强低光照环境下的图像清晰度,抑制雨雪天气的噪声,提升目标识别准确率;在视频压缩传输中,预处理通过去冗余和伪影抑制,降低码率需求,提升传输效率;在医疗影像分析(如内窥镜视频、超声视频)中,预处理可减少运动伪影,增强病灶区域特征,辅助医生诊断;在自动驾驶领域,实时视频预处理需平衡计算复杂度与效果,如通过动态范围调整(如HDR融合)应对强光逆光场景,确保感知系统可靠。

视频预处理面临诸多挑战,首先是实时性问题,高分辨率视频(如4K/8K)的帧间处理需低延迟算法,这对硬件计算能力提出高要求;其次是运动适应性,静态区域与运动区域的预处理策略需差异化,避免运动模糊或噪声残留;光照变化、场景复杂性等因素也要求预处理算法具备鲁棒性,传统直方图均衡化在光照剧烈变化时可能过度增强噪声,而自适应直方图均衡化(如CLAHE)虽能改善局部对比度,但计算量增加,近年来,基于深度学习的预处理方法(如基于CNN的去噪网络、光流估计网络)逐渐兴起,通过端到端学习提升处理效果,但需大量标注数据且模型部署成本较高。

为更直观对比常见预处理技术的特点,以下表格总结了部分核心方法及其适用场景:

| 预处理技术 | 主要作用 | 适用场景 | 局限性 |

|---|---|---|---|

| 高斯滤波 | 抑制高斯噪声,平滑图像 | 静态场景、低噪声视频 | 可能模糊边缘细节 |

| 中值滤波 | 去除椒盐噪声,保护边缘 | 含有脉冲噪声的视频(如传输错误) | 对高斯噪声效果较差,计算量较大 |

| 帧间差分法 | 检测运动区域,分离背景与前景 | 运动目标检测、视频监控 | 对光照变化敏感,易产生空洞 |

| 光流估计与补偿 | 消除运动模糊,进行帧插值 | 高动态场景、视频稳定化 | 计算复杂度高,快速运动时估计精度下降 |

| CLAHE | 增强局部对比度,适应光照不均 | 医疗影像、低光照视频 | 可能引入过度增强的伪影 |

| 基于CNN的去噪网络 | 端到端学习,保留细节的同时去噪 | 高质量视频恢复、深度学习预处理 | 需训练数据,实时性依赖硬件加速 |

图像预处理技术是视频处理流程中不可或缺的环节,通过空间域与时间域的协同处理,可显著提升视频质量与分析效率,随着人工智能技术的发展,传统方法与深度学习的融合将成为趋势,以满足实时性、鲁棒性和复杂场景适应性的需求,在实际应用中,需根据视频特性、任务需求和硬件条件选择合适的预处理策略,以实现最佳效果。

相关问答FAQs

Q1:视频预处理与视频增强有何区别?

A:视频预处理是视频分析或处理前的基础步骤,旨在消除噪声、校正畸变、统一格式等,为后续任务(如目标检测、压缩)提供高质量输入,侧重于“标准化”和“问题修复”;而视频增强更侧重于主观视觉体验的提升,如色彩增强、超分辨率重建、动态范围调整等,目的是让视频更清晰、更美观,可能不直接服务于特定分析任务,预处理是增强的基础,增强可视为预处理的高级延伸。

Q2:如何在实时视频处理中选择合适的预处理算法?

A:选择实时视频预处理算法需综合考虑三个因素:一是计算复杂度,优先选择低复杂度算法(如高斯滤波而非深度学习去噪)或硬件加速友好的算法(如基于GPU的光流估计);二是场景特性,例如静态场景可用帧间平均去噪,而动态场景需运动自适应滤波;三是任务需求,若后续任务是目标检测,则背景减除和边缘增强优先;若任务是视频传输,则压缩伪影抑制和码率控制更关键,还需平衡处理效果与延迟,通常通过算法简化或区域处理(如仅处理感兴趣区域)来满足实时性要求。