什么是VR全景视频?

我们来明确它的定义。

VR全景视频是一种特殊的视频格式,它记录的不是传统意义上的一个固定视角的画面,而是一个特定空间中360度(或180度)全方位的视频流,当用户戴上VR头显(如Meta Quest、Pico等)或通过电脑/手机屏幕观看时,可以自由地转动头部,获得身处该虚拟空间中的沉浸式体验,仿佛身临其境。

核心特点:

- 360度沉浸感:覆盖水平360度和垂直180度(或360度)的视野,提供包裹式的视觉体验。

- 自由视角:用户可以自主控制视线方向,探索视频中的每一个角落,而不是被动地接受导演预设的镜头。

- 临场感:通过头显设备,放大了视觉包围感,使用户更容易产生“身在其中”的感觉。

核心技术原理

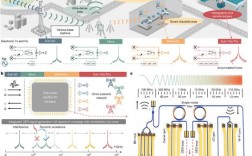

VR全景视频的诞生,是多种技术融合的产物,我们可以将其拆解为以下几个核心环节:

拍摄技术:捕捉“世界”

这是制作全景视频的第一步,目标是记录完整的空间信息。

-

硬件设备:

- 专业全景相机:这是最主流的方案,它由多个(通常为6个、8个、14个甚至更多)高清广角镜头组成,像一颗“球”一样排列,这些镜头同时拍摄,后期通过软件将多路视频拼接成一个完整的360度视频流,知名品牌如 Insta360 Pro, Kandao Obsidian, GoPro MAX 等。

- 多机位+同步器:使用多台单反或电影机,从不同角度对同一场景进行拍摄,通过精密的同步器确保所有相机的拍摄时间完全一致,这种方式画质极高,但成本高昂,后期拼接复杂,常用于高端电影制作。

- 无人机:搭载全景相机的无人机可以拍摄高空全景视频,提供独特的上帝视角。

-

关键技术点:

- 同步曝光:所有相机必须严格同步,否则在移动场景下会出现画面撕裂和错位。

- 视差校正:由于多镜头之间存在物理距离,拍摄近处物体时会产生视差差,导致后期拼接困难,高端相机会内置算法进行初步校正。

拼接技术:缝合“世界”

拍摄完成后,来自不同镜头的视频片段需要被无缝地“缝合”成一个完整的球面视频。

- 软件流程:

- 色彩校正:首先统一所有镜头的白平衡、曝光、对比度等,确保不同镜头的画面色彩基调一致,这是拼接成功的基础。

- 图像对齐:软件通过特征点匹配算法(如SIFT, SURF)自动寻找相邻画面中的重叠部分,并进行精确对齐。

- 接缝融合:对齐后,接缝处仍然可能因为光线、物体运动等原因产生瑕疵,融合算法会通过渐变、混合等方式,让接缝变得平滑自然,肉眼难以察觉。

- 主流软件:Adobe Premiere Pro (内置VR编辑工具), Autopano Video Pro, Kolor's Panotour Pro, Insta360 Studio等。

格式与编码技术:存储和传输“世界”

拼接完成后,我们需要一个高效的格式来存储和播放这个巨大的球面视频。

-

视频格式:

- 单球面视频:最常见的格式,视频的每一帧都是一个包含360度信息的“矩形”图像(通常是2:1的长宽比,即宽是高的两倍),播放器会根据用户的视角,从这个“矩形”上实时“抠”出对应的画面显示。

- 多面体投影:将360度空间投影到一个立方体、八面体或二十面体的多个面上,这种格式在播放时计算量更小,性能更好,适合游戏和实时交互。

- 等矩形投影:即我们常说的“小行星图”或“世界地图”式展开,它的优点是算法简单,但画面边缘的拉伸和变形非常严重。

-

编码技术:

- 高码率:为了保持高清晰度和流畅度,全景视频的码率通常远高于传统视频(一部4K 360°视频可能需要50-100+ Mbps)。

- 空间分辨率与分辨率:传统视频的分辨率是固定的(如3840x2160),而全景视频的“分辨率”概念更复杂,我们通常用单眼分辨率 来衡量,即当用户注视正前方时,能看到的清晰度,一个6K单眼分辨率的视频,其总像素量远超传统6K视频。

- 高效编码标准:H.264/AVC, H.265/HEVC (效率更高,文件更小), 以及面向未来的 AV1 等编码标准被广泛应用,以在有限带宽下提供尽可能好的画质。

播放与交互技术:进入“世界”

这是用户最终体验的环节,核心是实时渲染和交互。

-

播放器:

- VR头显播放器:如Oculus Video, SkyBox VR等,它们直接利用头显的陀螺仪和加速度计来追踪头部运动,实现低延迟的视角切换。

- 网页/桌面播放器:如YouTube, Facebook, Bilibili的360°视频播放器,它们通过鼠标拖动或手机陀螺仪来模拟视角移动。

-

核心交互技术:

- 头部追踪:通过IMU(惯性测量单元)实时获取头部的姿态(俯仰、偏航、滚转),并据此更新渲染的视角。

- 空间音频:为了增强沉浸感,声音也需要是3D的,声音的来源方向会与视频中的声源位置绑定,当用户转头时,声音也会随之变化,仿佛声音是从真实空间中传来的。

- 热点与交互:在全景视频中可以嵌入可点击的“热点”,用户点击后可以触发信息弹窗、跳转到另一个场景、播放一个嵌入的视频等,实现简单的交互叙事。

制作流程(简版)

一个专业的VR全景视频制作流程通常包括:

- 策划与勘景:确定拍摄主题、内容和场景,评估拍摄难度。

- 设备准备:选择合适的全景相机、三脚架、存储卡、电池等。

- 现场拍摄:架设设备,检查同步,进行拍摄,注意避开拍摄者本人(或后期去除)。

- 数据备份与转码:安全备份所有素材,并进行初步转码。

- 后期制作:

- 剪辑与拼接:使用专业软件进行色彩校正、拼接、融合。

- 调色与特效:进行风格化调色,添加字幕、特效等。

- 音频处理:混音,制作并添加空间音效。

- 导出与发布:根据发布平台要求,选择合适的格式、分辨率和码率进行导出,并上传至VR平台或视频网站。

核心挑战与局限

尽管VR全景视频技术已相当成熟,但仍面临诸多挑战:

-

数据量巨大:

- 拍摄:高分辨率、高帧率导致单机存储空间需求巨大,拍摄时间受限。

- 存储与传输:视频文件体积庞大,对硬盘、服务器带宽和用户网络要求极高。

-

画质与带宽的矛盾:

- 为了保证沉浸感,需要极高的分辨率和码率,但这与当前网络环境(尤其是移动网络)和硬件解码能力存在矛盾,如何在有限带宽下提供最佳画质,是持续研究的课题(如使用 foveated rendering,即只渲染用户注视中心的高清区域,周边区域降低分辨率)。

-

动态模糊与拼接瑕疵:

在快速移动的场景中,由于多镜头的曝光时间不完全同步,会产生严重的动态模糊和重影,导致拼接失败,这是目前行业的一大痛点。

-

叙事自由与导演控制的矛盾:

传统电影有明确的镜头语言,引导观众情绪,而全景视频将叙事权交给了用户,导演如何保证核心信息被有效传达,同时又不破坏用户的探索自由,是一个创作上的难题。

-

眩晕问题:

当视频中的运动(如快速平移、旋转)与用户自身的头部运动不匹配时,容易引发“动态病”(Cyber Sickness),导致用户眩晕、不适。

主要应用场景

VR全景视频凭借其独特的沉浸感,在多个领域大放异彩:

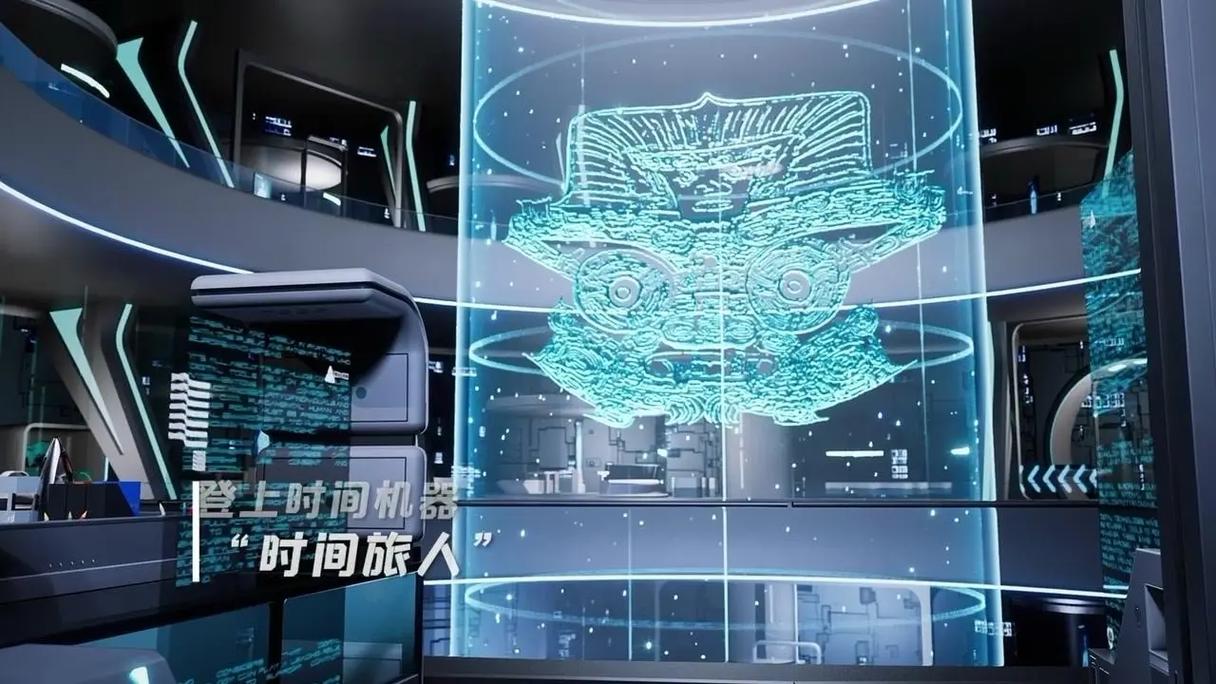

- 虚拟旅游:足不出户“游览”世界各地的名胜古迹、自然风光。

- 房地产与家居:让买家或租客“身临其境”地看房,感受房屋的空间和采光。

- 事件直播:音乐会、体育赛事、发布会等全景直播,提供比现场更灵活的观看视角。

- 教育培训:模拟危险环境(如消防演练)、历史场景重现、复杂设备操作教学等。

- 品牌营销:为汽车、酒店、产品等创建沉浸式体验广告,提升用户参与度。

- 影视娱乐:探索新的叙事方式,创造“可交互的电影”。

未来发展趋势

- 更高分辨率与更高帧率:向8K、12K甚至更高分辨率发展,并向120fps的高帧率迈进,追求极致的清晰度和流畅度。

- 光场视频:这是全景视频的下一代技术,它不仅记录了光线的方向,还记录了光线的强度和相位信息,这意味着用户不仅能改变视角,还能在特定范围内改变焦点(从前景看到后景,或反之),实现了真正的“数字孪生”。

- AI深度融合:AI将在各个环节大显身手,如AI辅助拼接、AI动态模糊修复、AI画质增强、AI自动生成空间音频等。

- 与实时渲染结合:全景视频将与游戏引擎(如Unreal Engine, Unity)结合,实现视频与实时3D场景的无缝切换和互动,创造更丰富的混合现实体验。

- 轻量化与便捷化:随着手机算力的提升和算法的优化,使用一部手机就能拍摄和播放高质量全景视频将成为常态。

VR全景视频技术通过拍摄、拼接、编码、播放四大核心环节,成功地将静态的360度全景图扩展为动态的、可交互的视频体验,它虽然面临着数据量、画质、眩晕等挑战,但在虚拟旅游、房地产、教育等领域的应用已证明了其巨大价值,随着光场、AI等新技术的融入,VR全景视频将朝着更真实、更智能、更互动的方向演进,持续拓展人类感知和体验世界的边界。