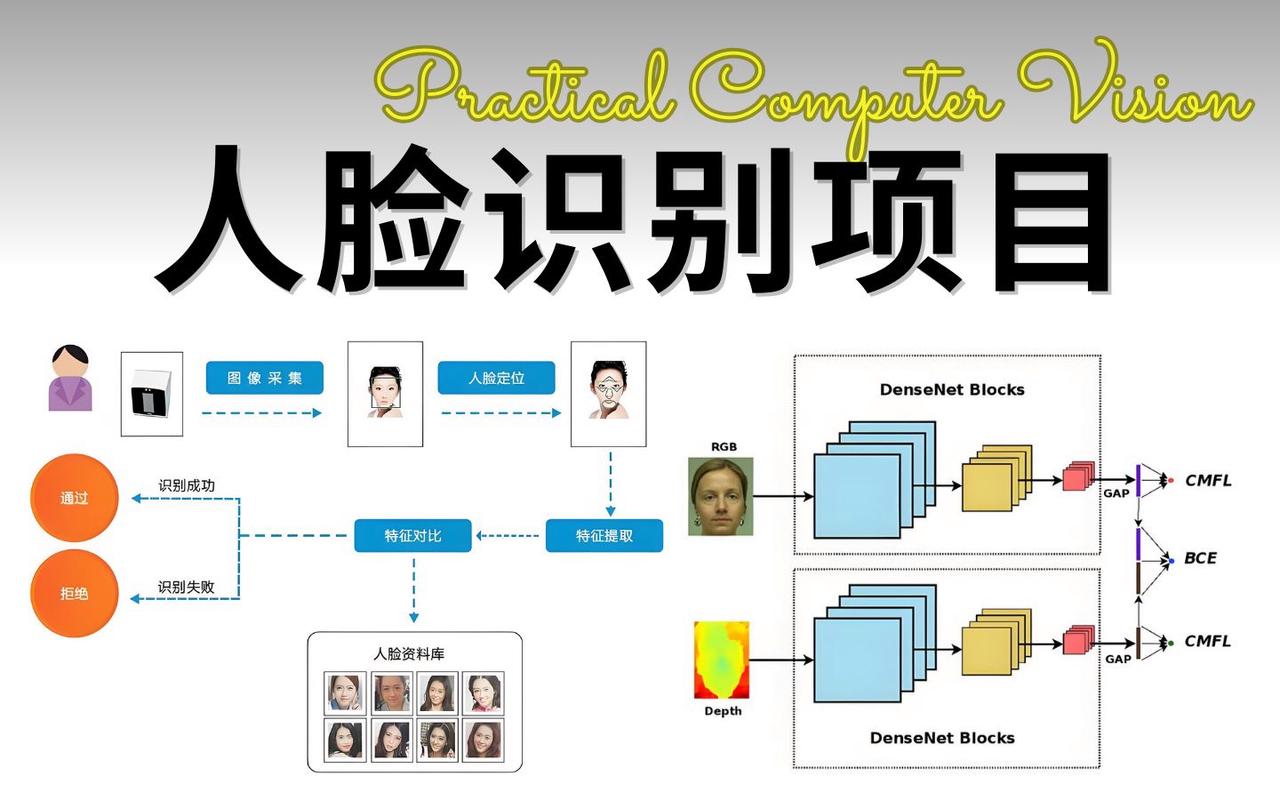

人脸识别技术的实现依赖于多学科技术的融合,涉及图像处理、模式识别、深度学习等多个领域,其核心流程包括人脸检测、关键点定位、特征提取、匹配识别以及活体检测等环节,每个环节都需要特定的技术支撑。

在人脸检测阶段,技术目标是图像中定位人脸位置并排除背景干扰,传统方法基于 Haar 特征和 Adaboost 算法,通过级联分类器快速筛选人脸区域,但受光照、姿态影响较大,当前主流技术基于深度学习,如 MTCNN(多任务级联卷积网络)通过同时执行人脸分类、边界框回归和关键点定位三个任务,实现高精度检测;YOLO(You Only Look Once)和 SSD(Single Shot MultiBox Detector)等单阶段目标检测算法,则能兼顾检测速度与精度,适用于实时场景。

人脸关键点定位(也称对齐)是后续特征提取的基础,需精确标注眼角、鼻尖、嘴角等特征点位置,传统方法如主动形状模型(ASM)和主动外观模型(AAM),依赖统计模型拟合特征点,但对姿态变化鲁棒性不足,深度学习技术中,基于热图回归的算法(如 HRNet)通过预测特征点热力图,可实现亚像素级定位,对大角度偏转、遮挡等情况适应性更强,为后续特征对齐提供坐标基准。

特征提取是人脸识别的核心,需将人脸图像转化为高维特征向量,确保同一人的不同图像特征相似度高,不同人的特征差异大,早期方法如局部二值模式(LBP)、方向梯度直方图(HOG)等手工特征,区分能力有限,深度学习时代,卷积神经网络(CNN)成为主流,如 FaceNet 通过三元组损失函数学习特征嵌入,将人脸映射到欧氏空间;ArcFace(Additive Angular Margin Loss)在特征空间中引入角度间隔,大幅提升特征判别性;DeepID 系列则通过多网络融合增强特征鲁棒性,基于 Transformer 的模型(如 ViT)也开始应用于人脸特征提取,通过自注意力机制捕捉全局特征关系。

特征匹配与识别阶段,需计算待识别人脸特征与数据库中特征的相似度,常用距离度量包括余弦相似度和欧氏距离,余弦相似度关注特征方向,对尺度变化不敏感,更适合人脸特征,为提升效率,常采用近似最近邻搜索算法(如 FAISS、Annoy)压缩特征维度,实现大规模库的快速检索。

活体检测是保障安全性的关键,防止照片、视频、面具等攻击,传统方法基于纹理分析(如检测屏幕反光)、眨眼检测等,但易被高仿攻击欺骗,深度活体检测通过多模态信息增强安全性:RGB 图像序列分析微表情动作(如眨眼、头部运动),红外图像利用体温特征区分真人与实体道具,3D 结构光(如 iPhone Face ID)则直接获取人脸深度信息,构建三维模型抵御平面攻击,基于时序信息的动态检测(如视频流中连续动作分析)和对抗样本训练,进一步提升了活体检测的鲁棒性。

以下技术支撑环节的简要对比:

| 技术环节 | 传统方法 | 深度学习方法 | 核心优势 |

|---|---|---|---|

| 人脸检测 | Haar 特征 + Adaboost | MTCNN、YOLO、SSD | 高精度、实时性强、抗干扰能力提升 |

| 关键点定位 | ASM、AAM | HRNet、热图回归 | 亚像素级精度、对大姿态鲁棒 |

| 特征提取 | LBP、HOG | FaceNet、ArcFace、DeepID | 高判别性、强泛化能力 |

| 活体检测 | 纹理分析、眨眼检测 | 多模态融合(RGB+红外+3D)、动态时序分析 | 有效抵御伪造攻击、安全性高 |

相关问答 FAQs

Q1:人脸识别在低光照或逆光环境下如何保证准确性?

A1:针对低光照问题,技术方案包括:① 图像增强预处理,如 Retinex 算法分离光照与反射分量,或基于深度学习的暗光图像增强(如 Zero-DCE);② 多光谱传感器融合,结合红外摄像头捕捉热辐射特征,补充可见光信息;③ 算法优化,如采用基于注意力机制的 CNN 模型,聚焦人脸关键区域特征,减少背景噪声干扰,在硬件端可通过补光设备或高动态范围(HDR)成像提升场景适应性。

Q2:人脸识别数据隐私如何保护?

A2:数据隐私保护主要通过技术和管理手段结合:① 数据脱敏,原始图像在采集后即进行匿名化处理,去除可识别信息;② 特征加密,提取的人脸特征向量通过同态加密或差分隐私技术保护,即使数据泄露也无法还原原始人脸;③ 本地计算,终端设备直接完成特征提取与匹配,原始图像不上传服务器(如手机端人脸解锁);④ 合规管理,遵循《个人信息保护法》等法规,明确数据收集目的和用户授权机制,建立数据访问审计流程。