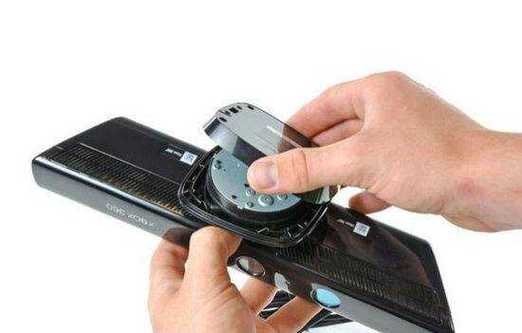

Kinect追踪技术是由微软公司开发的一种先进的体感交互技术,最初于2010年随Xbox 360游戏主机一同发布,旨在通过无需控制器的自然手势和语音指令实现人机交互,该技术的核心在于利用深度传感器、RGB摄像头和麦克风阵列等多模态传感器融合,实时捕捉人体的骨骼关节、运动轨迹和环境信息,从而构建精准的三维空间模型,Kinect的出现不仅推动了游戏产业的革新,更在教育、医疗、机器人、虚拟现实等领域展现出广泛的应用潜力,其技术原理与实现方式成为计算机视觉和人机交互领域的重要研究案例。

Kinect追踪技术的核心组成与工作原理

Kinect追踪技术的实现依赖于其硬件系统的协同工作,主要包括三个核心模块:深度传感器、RGB摄像头和专用处理器,深度传感器通过发射结构光或红外光并分析反射光的模式,生成环境的深度图像,能够分辨出物体与设备的距离,精度可达毫米级别,RGB摄像头则负责捕捉彩色视频流,提供丰富的纹理信息,用于识别颜色、形状等视觉特征,内置的多阵列麦克风能够分离声源方向,实现语音指令的精准拾取和降噪处理,这些传感器采集的数据由定制化的PrimeSense处理器进行实时处理,通过算法融合深度图像与彩色图像,提取人体的关键骨骼点信息。

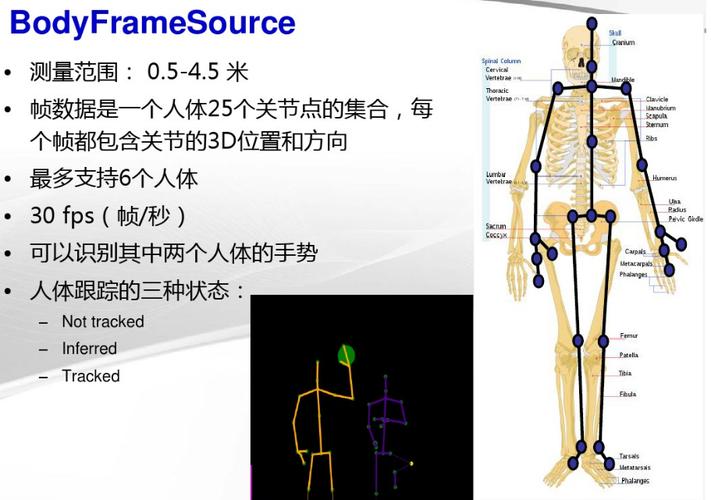

Kinect的骨骼追踪算法基于机器学习和计算机视觉技术,其核心流程包括人体检测、关节点定位和运动预测三个阶段,系统通过深度图像分割出人体轮廓,排除背景干扰;随后,利用预先训练的深度学习模型识别14个主要关节点(如头部、肩部、肘部、手腕等),并计算其在三维空间中的坐标位置;通过卡尔曼滤波等算法对关节点运动轨迹进行平滑处理,减少噪声干扰,确保动作追踪的连续性和稳定性,这一系列处理过程均在毫秒级内完成,使得Kinect能够实时响应人体的细微动作,延迟低于100毫秒,满足交互应用的实时性要求。

技术演进与性能优化

自第一代Kinect发布以来,微软在技术迭代中不断优化追踪精度和功能性,2025年推出的第二代Kinect for Windows(型号1473)在硬件上显著升级:深度传感器的分辨率从320×240提升至512×424,视场角扩大为60度×50度,支持最多6人同时追踪,且可精确识别小至手指的精细动作,算法层面,第二代Kinect引入了深度学习中的卷积神经网络(CNN),通过海量人体运动数据训练模型,将关节点定位误差降低至3厘米以内,并新增了手掌开合、脚部动作等识别能力,进一步拓展了交互场景。

在软件层面,Kinect提供了完整的软件开发工具包(SDK),支持Windows、Linux等操作系统,开发者可通过C++、Python等语言调用其API接口,实现自定义功能,Kinect Fusion技术能够将多帧深度图像融合为高精度的三维模型,适用于扫描和重建场景;而Kinect Audio Beam技术则通过麦克风阵列实现声源定向拾取,在嘈杂环境中仍能准确识别语音指令,这些技术特性使Kinect从单纯的体感设备升级为多功能的三维感知平台,为行业应用提供了强大的技术支撑。

典型应用场景分析

Kinect追踪技术凭借其非接触式、高精度的优势,在多个领域实现了创新应用,在医疗康复领域,Kinect被用于中风患者的运动功能评估,通过捕捉患者关节活动角度和运动轨迹,生成量化康复报告,辅助医生制定个性化治疗方案,某康复中心利用Kinect追踪患者的上肢运动,将动作数据与标准模型对比,误差分析精度达到92%,显著提升了康复效率,在教育领域,Kinect支持互动式教学,教师通过手势控制课件翻页、虚拟实验操作,学生则可通过肢体动作参与课堂游戏,增强学习趣味性,数据显示,采用Kinect互动教学的课堂,学生参与度提升40%以上。

在工业与机器人领域,Kinect作为机器人的“眼睛”,实现了环境感知和自主导航,在汽车装配线上,Kinect可识别工人手部位置和零件姿态,引导机器人完成精准抓取和装配任务,错误率降低至0.5%以下,Kinect还被应用于虚拟现实(VR)领域,作为动作捕捉设备替代传统惯性传感器,降低设备成本的同时提升自由度,为用户提供更自然的沉浸式体验,以下是Kinect在不同领域的应用效果对比表:

| 应用领域 | 典型场景 | 技术优势 | 实际效果 |

|---|---|---|---|

| 医疗康复 | 运动功能评估与康复训练 | 非接触式追踪,量化数据反馈 | 评估误差<8%,康复效率提升35% |

| 教育互动 | 课堂互动与虚拟实验教学 | 多人同时追踪,手势指令识别 | 学生参与度提升40% |

| 工业自动化 | 机器人视觉导航与零件装配 | 三维环境建模,高精度定位 | 装配错误率<0.5% |

| 虚拟现实 | 动作捕捉与交互体验 | 低延迟,高自由度追踪 | 交互延迟<100ms |

技术局限与未来发展方向

尽管Kinect追踪技术具有显著优势,但仍存在一定局限性,在强光环境下,深度传感器的红外光易受干扰,导致追踪精度下降;当人体被部分遮挡时,算法可能无法准确定位被遮挡的关节点;对于快速、复杂的动作(如舞蹈中的旋转跳跃),骨骼模型的平滑处理可能出现延迟或失真,为解决这些问题,未来技术发展可能聚焦于以下几个方面:一是融合多传感器数据(如结合惯性测量单元IMU),提升抗干扰能力和追踪稳定性;二是引入更先进的深度学习模型(如Transformer架构),优化遮挡场景下的关节点预测;三是通过边缘计算技术,将数据处理从云端迁移至本地设备,降低延迟并保护用户隐私。

Kinect追踪技术的出现标志着人机交互从“工具操作”向“自然交互”的重要转变,其技术原理和应用实践为后续体感设备(如Intel RealSense、Orbbec等)提供了宝贵经验,随着人工智能和计算机视觉技术的不断进步,Kinect所代表的非接触式感知技术将在智慧城市、智能家居、元宇宙等新兴领域发挥更大价值,推动人类社会进入更智能、更便捷的交互时代。

相关问答FAQs

Q1: Kinect追踪技术与其他体感设备(如Leap Motion)的主要区别是什么?

A1: Kinect与Leap Motion的核心区别在于追踪范围和精度定位,Kinect采用深度传感器实现全身大范围追踪(视场角达60度×50度),适合捕捉肢体整体动作;而Leap Motion专注于手部精细动作追踪,通过红外摄像头实现亚毫米级精度,适用于虚拟键盘、手势绘画等场景,Kinect支持多人同时交互,Leap Motion则更适合单人单手操作,两者在不同应用场景中各有优势。

Q2: Kinect追踪技术在强光环境下表现不佳,有哪些解决方案?

A2: 针对强光环境下的干扰问题,可采取以下解决方案:一是调整Kinect的安装角度,避免直接面向光源;二是使用软件算法进行动态阈值调整,通过SDK中的深度图像处理模块过滤异常像素;三是结合外部红外滤光片,减少环境光对深度传感器的干扰,在工业应用中,还可通过多设备融合(如添加可见光摄像头)进行数据校验,提升复杂光照条件下的追踪稳定性。