slam技术,即同步定位与地图构建(simultaneous localization and mapping),是一种让移动设备在未知环境中同时进行自身定位和环境地图构建的核心技术,就像一个人在黑暗的房间里摸索,既要知道自己当前的位置(定位),又要逐步勾勒出房间的布局(地图构建),slam技术就是为机器人、自动驾驶汽车、无人机等智能设备赋予这种“边走边看边画图”的能力,这项技术自20世纪80年代末提出以来,已成为自主移动系统的基石,广泛应用于工业自动化、消费电子、智慧城市、增强现实等多个领域,其核心挑战在于如何解决“鸡生蛋还是蛋生鸡”的悖论——没有精确的位置信息就无法构建准确的地图,而没有准确的地图又无法实现精确定位。

slam技术的基本原理与核心组件

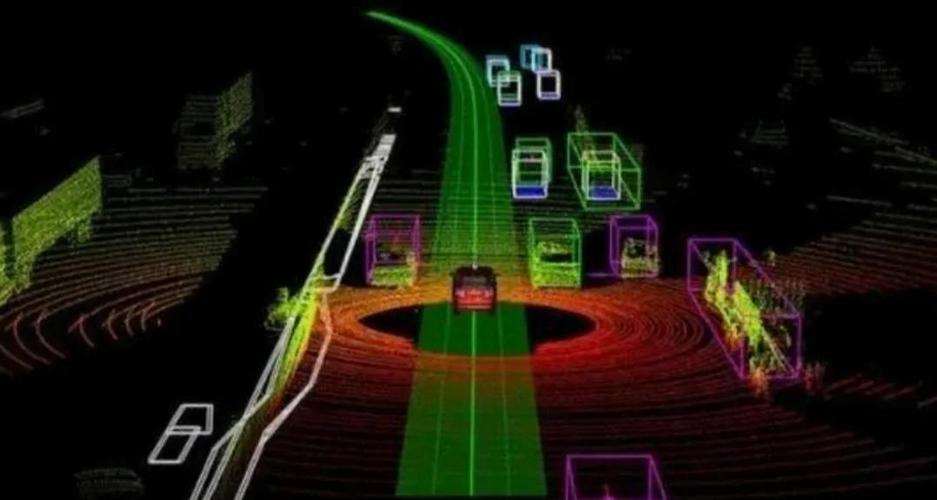

slam技术的实现依赖于传感器数据融合、算法优化和状态估计三大核心环节,设备通过传感器(如激光雷达lidar、摄像头、毫米波雷达、超声波传感器、imu惯性测量单元等)采集环境信息,这些传感器各具特点:lidar通过发射激光束并测量反射时间来生成高精度三维点云数据,适合结构化环境;摄像头则能提供丰富的纹理和色彩信息,但计算复杂度较高;imu可实时测量设备的加速度和角速度,弥补传感器采样频率低的缺陷,多传感器数据融合是slam的关键,通过卡尔曼滤波、粒子滤波或优化算法(如g2o、ceres)将不同传感器的数据对齐,消除噪声和误差,提高状态估计的准确性。

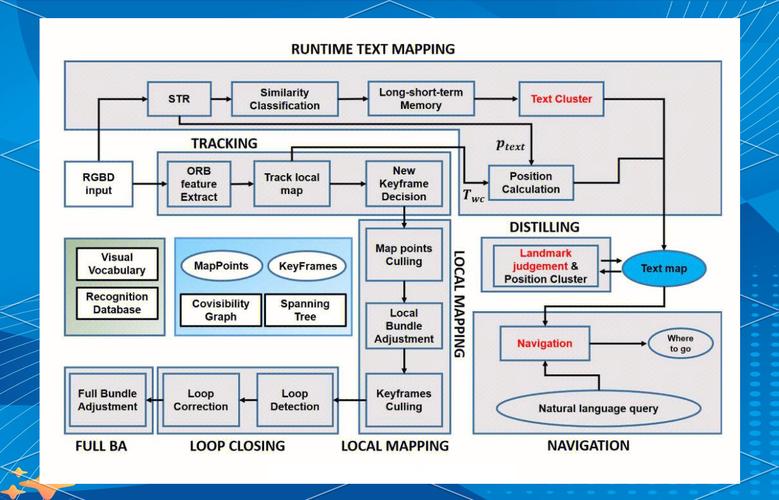

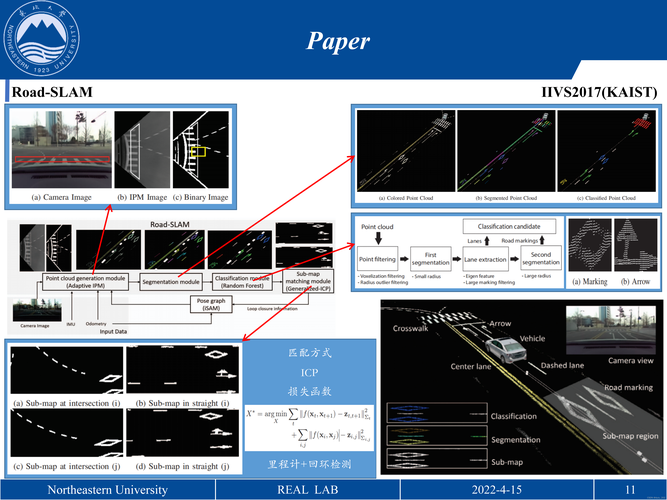

slam算法需要解决“数据关联”问题,即判断当前观测到的环境特征(如墙角、边缘、特定物体)是否与地图中已有特征匹配,这一过程通常通过特征提取与匹配实现,例如在视觉slam中,使用orb、sift、surf等算法提取图像的特征点,并通过描述子匹配实现跨帧关联,在激光slam中,则通过点云配准算法(如icp、ndt)将当前扫描的点云与历史地图对齐,计算设备的位姿变化。

slam通过“前端”和“后端”的协同工作完成实时定位与地图优化,前端负责处理传感器数据,实时估计设备位姿并更新局部地图;后端则通过优化算法(如图优化bundle adjustment)调整所有历史位姿和地图特征,消除累积误差,实现全局一致性,这一过程中,“回环检测”(loop closure)技术至关重要,当设备回到已访问过的区域时,通过识别环境特征匹配,修正路径误差,避免地图漂移,在无人机的室内导航中,当无人机飞回起点时,回环检测会识别出与初始位置相同的特征点,从而调整整个飞行路径的位姿估计,确保地图的闭合性。

slam技术的分类与典型算法

根据传感器类型,slam可分为激光slam、视觉slam(v-slam)、多传感器融合slam等,激光slam以lidar为核心,优势在于测距精度高、抗光照干扰,适合结构化环境(如工厂、仓库),典型算法如gmapping、cartographer、hector_slam,cartographer通过子图优化和闭环检测实现大场景鲁棒建图,被广泛应用于扫地机器人;hector_slam则依赖lidar数据直接迭代优化位姿,无需里程计,适合动态较少的环境。

视觉slam(v-slam)以摄像头为主要传感器,成本较低、信息丰富,但受光照、纹理、运动模糊等因素影响较大,根据是否使用深度信息,v-slam可分为稀疏slam(如orb-slam)、半稠密slam(如dso)和稠密slam(如volumetric fs-slam),orb-slam是经典的开源算法,通过orb特征点实现跟踪、局部建图和闭环检测,支持单目、双目和rgb-d相机,在ar领域应用广泛;而稠密v-slam则直接对图像像素进行深度估计,构建完整的表面模型,适合需要精细地图的场景(如自动驾驶的高精地图构建)。

多传感器融合slam通过结合lidar、视觉、imu等传感器的优势,弥补单一传感器的局限性,在自动驾驶中,激光slam提供精确的几何信息,视觉slam补充纹理和语义信息,imu则提供高频运动数据,三者融合可实现全天候、全场景的鲁棒定位,典型方案如livox-mid360与视觉相融合的slam系统,通过时间同步和外参标定,确保多传感器数据的一致性。

slam技术的挑战与发展趋势

尽管slam技术已取得显著进展,但仍面临诸多挑战,动态环境是主要难题之一,当环境中存在移动物体(如行人、车辆)时,传统slam算法容易将动态特征误认为静态地图,导致定位和建图错误,近年来,基于深度学习的动态slam(如dslam、dynslam)通过语义分割识别动态物体,并过滤其对地图的影响,显著提升了算法的鲁棒性。

实时性与精度平衡是另一挑战,尤其是在大场景或高动态环境中,复杂的计算量可能导致系统延迟,为此,轻量化算法(如orb-slam3的优化版本)和硬件加速(如fpga、gpu并行计算)成为研究热点,长期slam(long-term slam)问题也逐渐受到关注,即设备在长时间运行后,环境可能发生变化(如家具移动、光照变化),如何让地图具备自适应更新能力,是未来重要方向。

在应用层面,slam正从“定位建图”向“场景理解”延伸,结合语义分割、目标检测等技术,slam不仅能构建几何地图,还能标注场景中的语义信息(如“这是桌子”“那是门”),为机器人提供更高层次的决策依据,在服务机器人中,语义slam可帮助机器人理解环境布局,实现更自然的交互;在ar中,通过slam构建的几何地图与虚拟模型结合,实现虚实融合的沉浸式体验。

相关问答FAQs

问题1:slam技术与传统导航定位(如gps)有什么区别?

解答:传统导航定位(如gps)依赖外部卫星信号,在室内、地下或信号遮挡区域失效,且只能提供位置信息,无法构建环境地图,而slam技术不依赖外部信号,通过自身传感器在未知环境中自主定位和建图,适合无gps场景(如室内、矿井、深海),gps定位精度受卫星数量和大气影响,误差可达米级,而slam在良好环境下可达到厘米级精度,且能生成详细的环境地图,支持自主避障、路径规划等复杂任务。

问题2:如何选择适合自己应用的slam方案?

解答:选择slam方案需综合考虑应用场景、传感器成本、精度要求和实时性需求,扫地机器人通常采用激光slam(如cartographer)或视觉slam(如orb-slam),成本低且能满足家庭环境定位需求;自动驾驶汽车则需要多传感器融合slam(lidar+视觉+imu),确保全天候高精度定位;ar设备则倾向于视觉slam(如苹果arkit的v-slam),兼顾成本和用户体验,还需考虑开发难度,开源方案(如orb-slam、cartographer)适合快速原型验证,而商业方案(如nvidia的drivepx系列)提供更成熟的优化和部署支持。