增强现实全息技术原理主要涉及光学、计算机图形学、传感器融合和显示技术等多个领域的交叉融合,其核心目标是在真实环境中生成并叠加具有深度感知的虚拟全息影像,实现虚拟与现实的实时交互,以下从技术基础、核心原理、实现流程及关键组件等方面进行详细阐述。

技术基础与核心概念

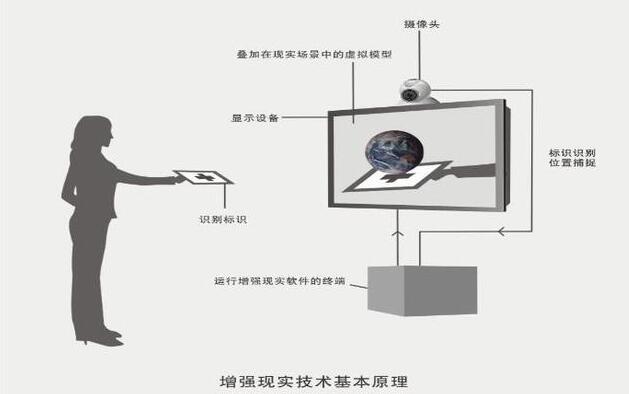

增强现实(AR)全息技术是在传统AR基础上,通过全息显示方式替代普通屏幕显示,使虚拟影像更接近真实物体的视觉特性,全息技术本身基于光的干涉和衍射原理,记录并再现光波的振幅和相位信息,从而形成具有立体感的图像,而AR全息技术则需进一步解决虚拟影像的空间定位、环境融合及实时交互问题,其核心挑战在于如何将虚拟全息信息精准叠加到真实场景中,并确保用户在不同视角下观察时影像的连贯性和真实感。

核心技术原理

光场显示与全息成像

传统全息技术需要激光记录和再现,且对环境要求苛刻,现代AR全息技术则采用计算全息(Computer-Generated Holography, CGH)和光场显示(Light Field Display)相结合的方式,计算全息通过算法生成全息图样,再由空间光调制器(SLM)调制相干光(如激光)或非相干光,形成衍射光波,最终在空间中重建三维影像,光场显示则通过记录和再现光线在空间中的传播方向和强度信息,使用户在自然移动头部时能观察到不同视角的影像细节,无需佩戴特殊眼镜即可裸眼观看。

空间定位与追踪技术

为实现虚拟全息影像与真实环境的精准对位,需依赖高精度空间定位技术,目前主流方案包括:

- 传感器融合:结合惯性测量单元(IMU)、摄像头、GPS和UWB(超宽带)等传感器,实时获取设备姿态、位置及环境信息,通过SLAM(同步定位与地图构建)技术,设备可实时识别环境特征点,构建三维地图,并计算虚拟影像的放置坐标。

- 环境理解:利用计算机视觉算法分析真实场景的几何结构和光照条件,确保虚拟全息影像的阴影、反射等效果与真实环境一致,提升沉浸感。

三维建模与渲染

虚拟全息影像的生成需先通过三维建模软件创建数字模型(如CAD模型、3D扫描数据等),再通过实时渲染引擎(如Unity、Unreal Engine)处理模型数据,渲染过程需考虑光的物理特性,包括反射、折射、散射等,通过着色器(Shader)算法模拟光与虚拟物体的相互作用,生成符合真实感的光强分布和相位信息,为满足实时性要求,渲染引擎需优化计算效率,通常采用延迟渲染(Deferred Rendering)或光线追踪(Ray Tracing)技术加速。

显示技术

显示设备是AR全息技术的最终输出端,其核心在于将生成的全息信息转化为可见光波,目前主流方案包括:

- 空间光调制器(SLM):如液晶硅(LCoS)或数字微镜器件(DMD),通过调制入射光的相位或振幅,形成全息图样,SLM的分辨率和响应速度直接影响影像的清晰度和流畅度。

- 全息显示屏:采用特殊材料(如光聚合物、液晶层)记录或动态生成全息图,可实现更大视角和更高亮度,但技术尚不成熟。

- 纳米光子学技术:通过超表面(Metasurface)等亚波长结构调控光波传播,实现轻薄化的全息显示模块,是未来发展方向之一。

光照与色彩一致性

为使虚拟全息影像与真实环境自然融合,需统一两者的光照条件,通过环境光传感器采集真实场景的色温、亮度信息,渲染引擎据此调整虚拟影像的光照参数(如阴影方向、高光强度),采用广色域显示技术(如OLED、MicroLED)确保色彩还原准确,避免因色差导致的视觉割裂感。

实现流程

AR全息技术的实现可分为以下步骤:

- 数据采集:通过传感器获取设备姿态、位置及环境图像数据。

- 环境理解:利用SLAM算法构建三维环境地图,识别平面、障碍物等特征。

- 三维建模与渲染:加载虚拟模型,结合环境光照信息进行实时渲染,生成全息图数据。

- 全息显示:将全息图数据传输至SLM或全息显示屏,通过光学系统投射至空间中。

- 交互反馈:通过手势识别、眼动追踪等技术捕捉用户操作,实时更新虚拟影像的状态。

关键性能指标

| 指标类型 | 具体参数 | 技术意义 |

|---|---|---|

| 显示性能 | 分辨率(如4K/8K) | 影像清晰度,分辨率越高,细节表现越丰富 |

| 视角(>60°) | 用户可观察的最大角度,视角越大,自由度越高 | |

| 刷新率(≥90Hz) | 影像流畅度,高刷新率可减少动态模糊 | |

| 精度性能 | 定位精度(毫米级) | 虚拟影像与真实环境对位的准确性 |

| 追踪延迟(<20ms) | 从传感器采集到显示输出的时间延迟,延迟过高会导致眩晕感 | |

| 交互性能 | 响应时间(<50ms) | 用户操作到虚拟影像更新的时间,影响交互实时性 |

| 环境适应性 | 工作光照范围(1-10000lux) | 在不同光照环境下的显示效果,强光下需高亮度屏幕 |

应用场景

AR全息技术目前已应用于多个领域:在医疗领域,医生可通过全息影像观察患者器官的三维结构,辅助手术规划;在工业领域,工程师可将虚拟装配模型投射至生产线,指导实际操作;在教育领域,学生可通过裸眼观察全息解剖模型,提升学习效率;在娱乐领域,全息演唱会、虚拟角色交互等应用正逐步落地。

相关问答FAQs

问题1:AR全息技术与传统AR显示(如手机屏幕)的核心区别是什么?

解答:传统AR显示通过二维屏幕叠加虚拟信息,缺乏深度感知和立体感,用户需依赖特定视角观察,而AR全息技术基于光场显示和计算全息,直接在空间中生成三维影像,支持多角度裸眼观看,且虚拟影像具有真实的景深和视差效果,视觉沉浸感更强,全息技术可实现虚拟物体与真实环境的物理交互(如遮挡、反射),而传统AR仅能实现平面叠加。

问题2:当前AR全息技术面临的主要挑战有哪些?

解答:当前挑战主要包括三方面:一是硬件限制,如SLM的分辨率和响应速度不足,导致全息影像清晰度和动态效果有限;二是计算复杂度高,实时生成高质量全息图需强大的算力支持,现有设备功耗和体积难以平衡;三是环境适应性,复杂光照条件(如强光、反光)和动态场景会导致全息影像失真或定位偏差,未来需通过新型显示材料、边缘计算算法及AI环境感知技术突破这些瓶颈。