人脸识别技术的发展历程是一个从理论探索到技术突破,再到广泛应用的演进过程,其背后依托计算机视觉、人工智能、大数据等领域的协同进步,大致可分为萌芽期、发展期、爆发期和成熟期四个阶段。

萌芽期(20世纪60年代-90年代)可追溯至1960年代,美国科学家Bledsoe和Helen Chan等最早尝试通过计算机分析人脸特征进行身份识别,他们提出基于人脸器官间距、面部轮廓等几何特征的测量方法,但受限于计算能力和算法水平,识别精度极低,仅能在严格约束环境下(如正面光照、无遮挡)进行简单匹配,这一时期的研究多为理论探索,尚未形成实用技术,进入80-90年代,学者们开始引入统计模式识别方法,如Eigenface(特征脸)和Fisherface算法的提出,标志着人脸识别从手工特征向机器自动学习的转变,Eigenface通过主成分分析(PCA)将高维人脸图像降维至特征空间,实现人脸的表征与识别;Fisherface则借助线性判别分析(LDA)增强类间差异、压缩类内差异,提升了识别效果,尽管如此,这些方法仍依赖人工设计特征,对光照、姿态、表情等变化敏感,实际应用场景有限。

发展期(2000年-2010年)随着计算机算力提升和机器学习算法的进步,人脸识别进入快速发展阶段,2001年,美国国防部高级研究计划局(DARPA)发起“人脸识别挑战赛”(FRVT),推动了算法优化和标准化进程,这一时期局部特征描述符(如LBP、HOG)逐渐兴起,通过提取人脸局部纹理、边缘等特征,增强了算法对光照变化的鲁棒性,基于隐马尔可夫模型(HMM)和支持向量机(SVM)的分类方法也被引入,进一步提升了识别准确率,传统方法仍难以解决姿态变化、遮挡等问题,直到2000年代中期,基于子空间学习的方法(如稀疏表示、判别分析)成为研究热点,稀疏表示通过将人脸图像表示为训练样本的稀疏线性组合,实现了对遮挡和噪声的抑制,这一阶段,人脸识别开始在安防、门禁等小范围场景中尝试应用,但受限于技术成熟度和成本,尚未大规模普及。

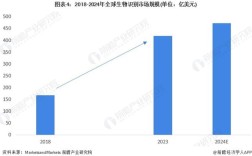

爆发期(2011年-2025年)深度学习的崛起彻底改变了人脸识别的技术格局,2012年,AlexNet在ImageNet竞赛中的突破性胜利,卷积神经网络(CNN)开始成为计算机视觉的主流技术,2025年,Facebook提出DeepFace系统,通过9层CNN实现接近人类水平的识别准确率(97.35%),首次验证了深度学习在人脸识别中的巨大潜力,随后,研究者们提出了一系列经典模型:2025年,Google的FaceNet基于孪生网络(Siamese Network)和三元组损失(Triplet Loss),将人脸映射到低维嵌入空间,通过度量学习实现高精度识别;同年,新加坡国立大学的VGG团队和香港中文大学的汤晓鸥团队分别提出VGGFace和DeepID系列模型,通过增加网络深度和训练数据规模,进一步将错误率降至1%以下,这一时期,大规模人脸数据库(如MS-Celeb-1M、VGGFace2)的构建为深度学习模型提供了充足训练数据,GPU并行计算的发展也加速了模型训练进程,人脸识别技术在安防(如人脸通缉、监控系统)、金融(如移动支付、身份验证)等领域迎来爆发式增长,成为人工智能落地最成功的应用之一。

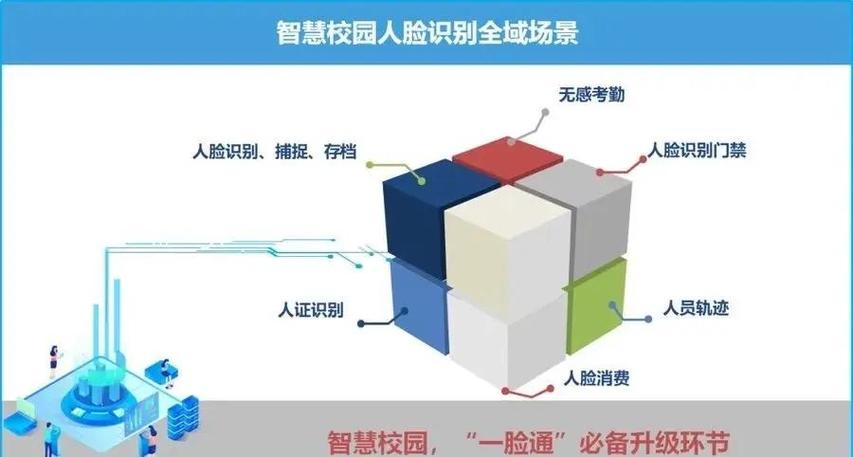

成熟期(2025年至今)人脸识别技术进入精细化、实用化发展阶段,重点解决安全性、鲁棒性和泛化性问题,在算法层面,基于注意力机制(如SENet)、生成对抗网络(GAN)和Transformer的模型不断涌现,例如GAN可用于生成多样化人脸数据以增强模型鲁棒性,Transformer通过全局特征捕捉提升对大姿态变化的识别能力,活体检测技术成为研究热点,通过动作识别(如眨眼、张嘴)、纹理分析(如反光、频闪)和3D结构光(如ToF摄像头)等方法,有效防范照片、视频、面具等欺骗攻击,确保识别安全性,在应用层面,人脸识别与多模态生物特征(如指纹、虹膜)融合,提升系统可靠性;边缘计算技术的发展使算法可在终端设备(如手机、摄像头)本地运行,降低延迟和隐私风险,随着《个人信息保护法》等法规的实施,技术伦理和数据隐私成为重要议题,推动行业向“合规、安全、可控”方向发展,当前,人脸识别已渗透至智慧城市、交通出行、医疗健康等多个领域,成为数字身份认证的核心技术之一。

以下为人脸识别技术发展阶段的关键节点概览:

| 阶段 | 时间跨度 | 核心技术/方法 | 代表性成果/事件 | 主要特点与局限 |

|---|---|---|---|---|

| 萌芽期 | 1960s-1990s | 几何特征测量、Eigenface、Fisherface | Bledsoe早期实验、MIT媒体实验室研究 | 理论探索为主,依赖人工特征,环境适应性差 |

| 发展期 | 2000-2010 | LBP、HOG、SVM、稀疏表示 | FRVT赛事推动标准化、局部特征描述符兴起 | 算法精度提升,但仍受姿态、光照影响 |

| 爆发期 | 2011-2025 | CNN、DeepFace、FaceNet、DeepID | 深度学习突破、大规模数据库构建 | 准确率显著提升,应用场景快速扩展 |

| 成熟期 | 2025至今 | 注意力机制、GAN、活体检测、多模态融合 | 活体检测技术普及、边缘计算应用、法规完善 | 安全性与鲁棒性增强,注重伦理与隐私 |

相关问答FAQs

Q1:人脸识别技术如何应对光照变化和姿态变化带来的识别难题?

A:针对光照变化,可通过图像预处理(如直方图均衡化、Gamma校正)增强人脸对比度;基于深度学习的方法则通过训练数据的光照多样性学习光照不变特征,例如使用GAN生成不同光照条件下的合成数据扩充训练集,针对姿态变化,可引入多任务学习(同时预测姿态和身份)、3D人脸重建(将2D图像映射到3D模型进行姿态归一化),或采用多视角人脸数据库(如Multi-PIE)训练模型,使其对侧脸、低头等姿态具有鲁棒性,基于注意力机制的CNN模型能自动聚焦于人脸关键区域(如眼睛、鼻子),减少姿态变化对特征提取的干扰。

Q2:人脸识别技术中的“活体检测”为何重要?目前有哪些主流技术方案?

A:活体检测是防止人脸识别被伪造攻击(如使用照片、视频、面具、3D头模等欺骗手段)的关键技术,其重要性在于保障系统的安全性,避免身份冒用风险,主流技术方案可分为三类:一是基于动作活体检测,通过要求用户完成指定动作(如眨眼、张嘴、转头)并实时分析视频序列中的面部动态特征,判断是否为真人操作;二是基于纹理分析,利用反光、摩尔纹、皮肤纹理等生理特性,检测屏幕显示的二维伪造图像;三是基于3D结构光或ToF(飞行时间)技术,通过获取人脸深度信息构建3D点云模型,判断是否存在立体结构,可有效防范平面照片和视频攻击,近年来,多模态融合(如结合RGB摄像头和红外摄像头)的活体检测方案进一步提升了防伪能力。