谷歌自动驾驶技术,现由其母公司Alphabet旗下的Waymo主导,是一项融合了计算机视觉、传感器融合、人工智能决策和车辆控制等多领域尖端科技的复杂系统工程,其核心目标是通过环境感知、决策规划和车辆控制三大模块的协同工作,实现车辆在特定条件下的全自动驾驶,最终提升交通安全、效率,并改变人们的出行方式。

环境感知:构建车辆周围的360度数字环境

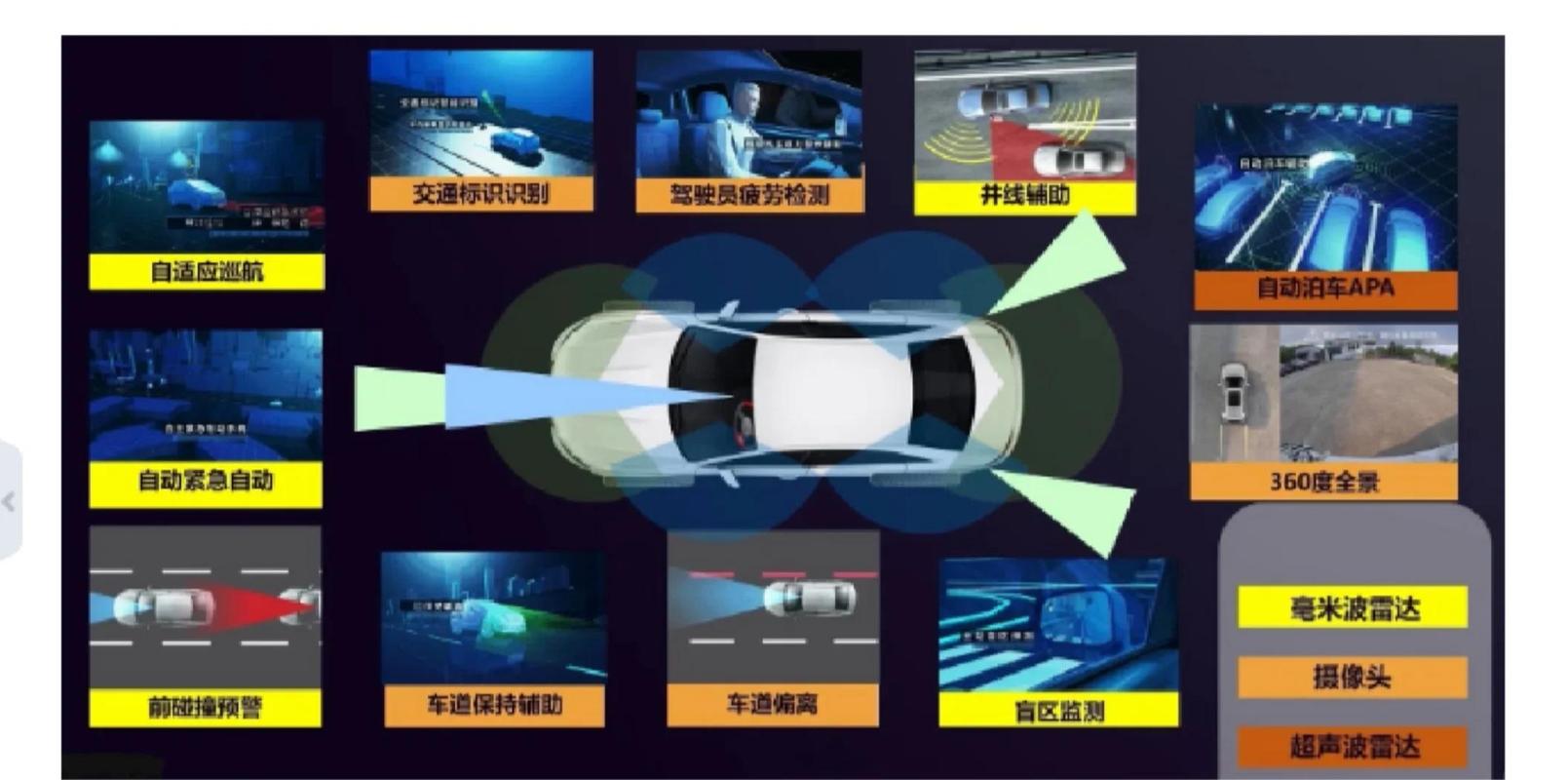

环境感知是自动驾驶的基础,如同人类的眼睛和耳朵,负责实时收集车辆周围的信息,谷歌自动驾驶系统采用了一套多传感器融合方案,以弥补单一传感器的局限性,提高感知的准确性和鲁棒性,主要传感器包括:

- 激光雷达(LiDAR):这是谷歌自动驾驶系统的核心传感器之一,通过发射和接收激光束,LiDAR能够精确测量周围物体与车辆的距离,生成高精度的三维点云图像,这种点云图像可以精确勾勒出车辆、行人、自行车、建筑物等物体的轮廓、位置和形状,并且不受光照条件的影响(无论是白天还是黑夜,晴天还是雨天),Velodyne的64线LiDAR能够每秒产生数百万个数据点,构建车辆周围半径约100-200米的详细环境模型。

- 摄像头:高分辨率摄像头负责捕捉周围环境的二维图像,提供丰富的颜色、纹理和语义信息,通过计算机视觉算法,摄像头可以识别交通信号灯、交通标志、车道线、车辆类型(如卡车、轿车)、行人姿态等,这些信息是LiDAR点云所不具备的,谷歌的自动驾驶系统采用了多个摄像头,覆盖不同的视角(前视、后视、侧视),以实现全方位的视觉感知。

- 毫米波雷达:毫米波雷达能够发射电磁波并接收反射信号,从而测量物体的距离、速度和方位角,它具有穿透性强(可穿透雨、雪、雾等恶劣天气)、探测距离远的特点,特别适合用于检测移动物体(如前车、接近的车辆)的速度,为碰撞预警和自适应巡航控制提供关键数据。

- 超声波传感器:主要用于近距离(几米内)的障碍物检测,如停车位检测、低速泊车时的近距离物体识别,以及在低速行驶时防止与路沿、其他车辆或行人发生碰撞。

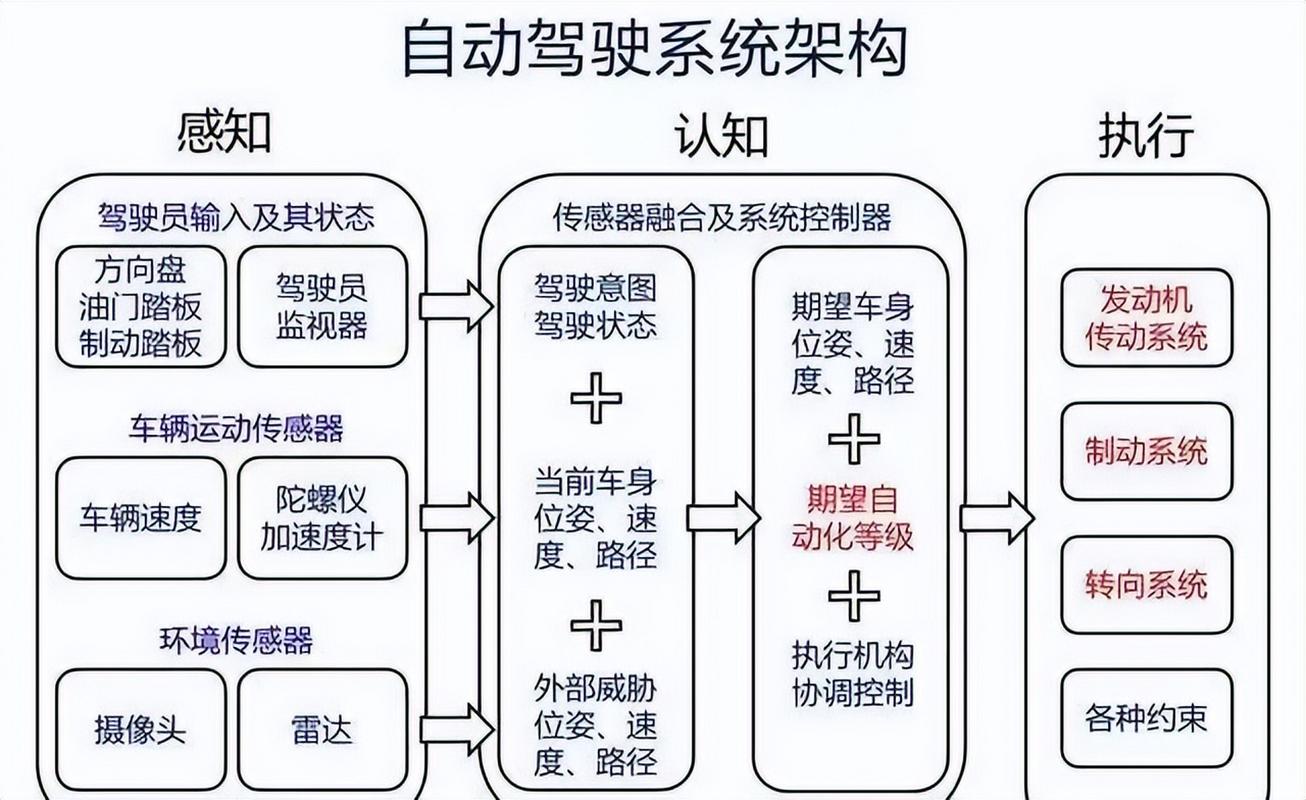

这些传感器收集到的原始数据是异构且海量的,需要通过传感器融合技术进行整合,谷歌采用的是一种基于卡尔曼滤波器(Kalman Filter)和更先进的非线性滤波方法(如粒子滤波器)的融合算法,以及深度学习模型(如卷积神经网络CNN用于视觉处理,点云处理网络如PointNet用于LiDAR数据处理),融合过程首先对每个传感器的数据进行时间同步和空间对齐,消除不同传感器之间的时间戳差异和安装位置偏差,通过算法将不同传感器的数据优势互补,LiDAR提供精确的几何位置,摄像头提供丰富的语义信息,毫米波雷达提供准确的速度信息,系统生成一个统一、准确、实时的环境模型,包含周围所有静态和动态物体的位置、速度、大小、类别等信息。

决策规划:智能选择安全、高效的行驶路径

在准确感知周围环境的基础上,决策规划模块如同自动驾驶系统的大脑,负责决定车辆应该“如何行驶”,这一过程包括三个层次:行为规划、路径规划和轨迹规划。

- 行为规划:这是最高层次的决策,根据当前交通规则、道路状况、目的地导航信息以及周围环境,确定车辆的宏观行为,是保持车道行驶、变道超车、转弯、停车等待还是避让行人,行为规划器会考虑多种可能的候选行为(如“跟车”、“换左道”、“换右道”),并通过一个代价函数(Cost Function)来评估每个行为的优劣,代价函数通常综合考虑安全性(如与周围物体的距离是否足够)、舒适性(如加减速是否平顺)、合规性(是否遵守交通规则)和效率(如是否能更快到达目的地)等因素,紧急避让行人的行为虽然可能带来较大的横向加速度,但安全性代价最低,因此会被优先选择。

- 路径规划:在确定了宏观行为后,路径规划器负责生成一条从当前位置到目标位置的空间几何路径,该路径需要满足车辆的运动学约束(如转弯半径不能太小)和安全性约束(不能与障碍物碰撞),常用的算法包括A*(A-star)算法、Dijkstra算法以及更适用于动态环境的RRT(快速随机树)算法,路径规划不仅考虑当前车道,还会预判前方多车道的路况,为可能的变道做准备。

- 轨迹规划:这是最精细的规划层次,将路径分解为一系列随时间变化的轨迹(包括位置、速度、加速度),轨迹规划器需要预测周围交通参与者(如其他车辆、行人)的未来几秒的运动轨迹(这通常依赖于其运动模型和感知数据),并在此基础上生成一条平滑、安全、舒适的车辆行驶轨迹,谷歌的轨迹规划大量采用了基于优化的方法,如二次规划(Quadratic Programming)或样条曲线拟合,通过最小化一个包含轨迹平滑度、舒适性、安全性等多目标的代价函数,得到最优的轨迹。

车辆控制:精确执行规划指令

车辆控制模块如同自动驾驶系统的手和脚,负责将决策规划模块输出的轨迹指令转化为具体的车辆控制动作,即控制油门、刹车和转向系统,使车辆精确地按照规划的轨迹行驶。

- 横向控制:负责控制车辆的转向角度,使其保持在车道内或按照规划的轨迹行驶,常用的控制算法有PID(比例-积分-微分)控制器、LQR(线性二次调节器)控制器以及基于模型预测控制(MPC)的算法,MPC因其能够处理约束条件(如转向角度限制、最大加速度限制)并预测未来状态,在高级自动驾驶中得到了广泛应用,横向控制器会实时接收车辆当前的位置、姿态(航向角)和规划轨迹的期望位置、航向角,通过计算误差来调整转向指令。

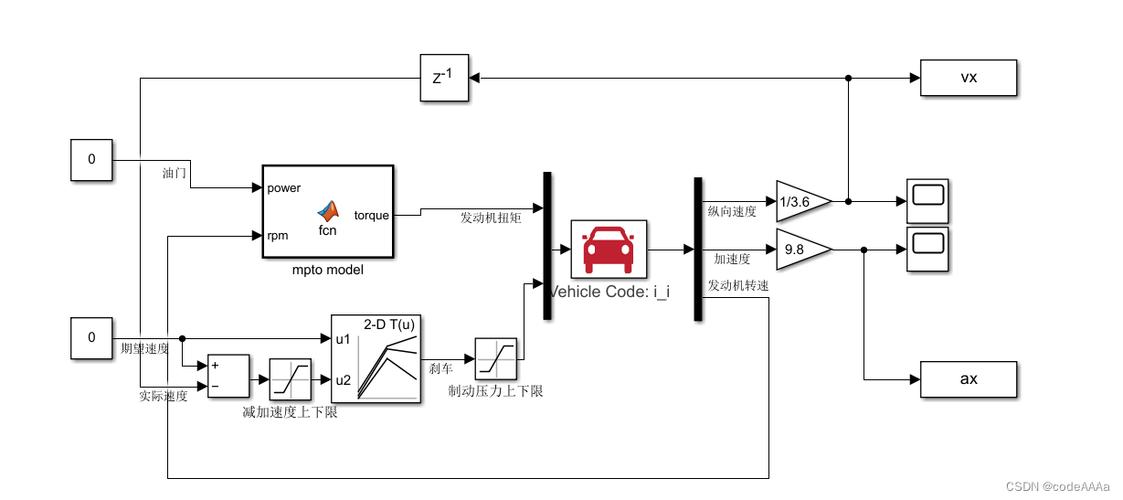

- 纵向控制:负责控制车辆的速度和加速度,使其与规划轨迹的速度曲线一致,纵向控制器通常采用PID或MPC算法,根据期望速度与当前速度的误差,计算油门开度或刹车制动压力,当前车减速时,纵向控制器会自动施加制动,保持安全车距;当需要加速时,则会控制油门踏板。

为了确保系统的可靠性和安全性,谷歌自动驾驶系统还包含了一套完善的冗余设计和故障安全机制,关键的传感器(如LiDAR、摄像头、计算单元)通常会有备份,当主传感器或计算单元发生故障时,备份系统可以立即接管,系统还具备“最小风险策略”(Minimal Risk Maneuver),在系统无法安全继续自动驾驶时(如传感器全部失效、遇到未知极端路况),会自动选择安全的操作,如靠边停车、开启双闪警示灯等。

相关问答FAQs

Q1: 谷歌自动驾驶汽车如何处理复杂的交通场景,如无交通信号灯的路口?

A1: 在无交通信号灯的路口,谷歌自动驾驶系统会通过环境感知模块实时监测路口周围所有交通参与者(包括其他车辆、行人、自行车)的位置、速度和意图,决策规划模块会基于这些信息进行多步骤推理:判断自身是否有优先通行权(如根据“停”标志、让行规则);预测其他交通参与者的未来轨迹,判断是否存在碰撞风险;通过代价函数评估不同通行策略(如“缓慢通过”、“等待”、“礼让行人”)的安全性、合规性和效率,选择最优方案,当系统检测到行人准备过马路时,即使自身有优先权,也会选择停车等待,以确保绝对安全,整个过程需要高精度的环境感知、准确的意图预测和快速的决策计算。

Q2: 谷歌自动驾驶技术在恶劣天气条件(如暴雨、大雪、浓雾)下的表现如何?

A2: 恶劣天气对自动驾驶技术确实是一个巨大挑战,但谷歌自动驾驶系统通过多传感器融合和算法优化来应对,LiDAR的激光束在暴雨或大雪中可能会因雨滴/雪花的散射而衰减,导致探测距离缩短和点云噪声增加,系统会通过增强信号处理算法(如滤波、聚类)来滤除噪声,并依赖毫米波雷达的穿透性来弥补LiDAR的不足,摄像头在浓雾或大雨中能见度会下降,系统会采用图像增强技术,并增加对其他传感器数据的依赖,系统会根据天气状况自动调整驾驶策略,如在暴雨中降低车速、增大跟车距离,避免急加速和急刹车,谷歌还会通过大量的仿真测试和封闭场地测试,在模拟的恶劣天气条件下验证和优化系统的性能,以提高其在真实恶劣天气中的鲁棒性,极端天气仍然是当前自动驾驶技术需要持续攻克的难题。