Cache技术,作为计算机体系结构中提升性能的核心手段,通过在高速存储与低速存储之间建立缓冲层,有效解决了数据访问速度不匹配的问题,在C语言编程环境中,Cache技术的理解与应用对优化程序性能至关重要,尤其涉及底层开发、系统编程及高性能计算领域,以下从Cache的基本原理、工作机制、在C语言中的具体实现及优化策略等方面展开详细阐述。

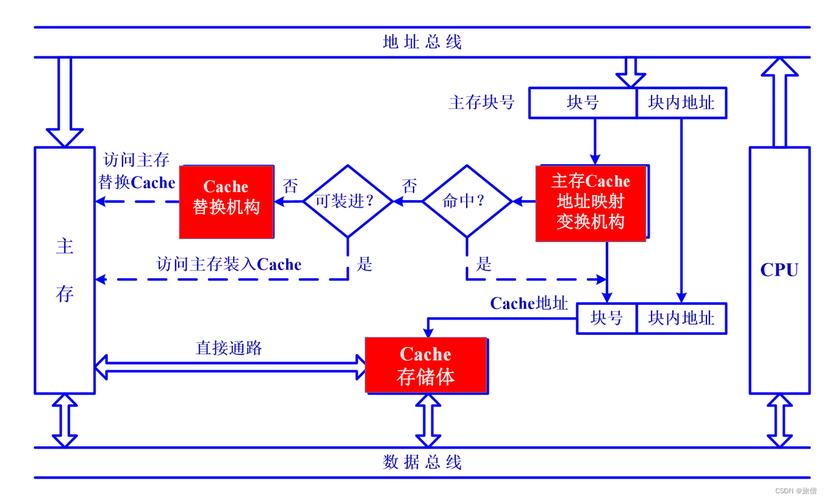

Cache技术的基本原理基于“局部性原理”,包括时间局部性和空间局部性,时间局部性指近期被访问的数据可能再次被访问,空间局部性指访问某个数据时,其相邻数据也可能被访问,Cache利用这一原理,将CPU频繁访问的数据从主存(如RAM)复制到速度更快的Cache存储器中,当CPU需要数据时,优先从Cache中查找,若命中(Cache Hit),则直接返回数据,避免访问较慢的主存;若未命中(Cache Miss),则从主存中加载数据到Cache,并返回给CPU,Cache的命中率是衡量其效率的关键指标,命中率越高,系统整体性能提升越显著。

Cache的工作机制涉及地址映射、替换算法和写策略三个核心环节,地址映射决定了主存数据如何存放在Cache中,常见映射方式包括直接映射、全相联映射和组相联映射,直接映射实现简单但冲突率高,全相联映射冲突率低但硬件复杂,组相联映射则折中两者性能,替换算法用于在Cache满时决定替换哪个数据块,常见算法有LRU(最近最少使用)、FIFO(先进先出)和随机替换,写策略则规定了Cache与主存数据一致性的维护方式,包括写回(Write-Back)和写直达(Write-Through),写回策略仅在数据被替换时写回主存,减少内存写入次数,但需额外标记位;写直达策略在每次数据写入时同步更新主存,保证一致性但降低性能。

在C语言中,Cache技术的应用主要体现在数据结构设计、内存访问模式优化及与硬件特性的结合,通过调整数组维度(如将多维数组按行优先存储)来利用空间局部性,减少Cache Miss;使用结构体填充(Padding)避免false sharing(伪共享),在多线程环境中提升Cache效率,C语言允许直接操作内存地址,可通过__builtin_prefetch等内建函数显式预取数据到Cache,或通过asm嵌入汇编指令控制Cache行为,以下表格列举了C语言中常见的Cache优化技巧及其适用场景:

| 优化技巧 | 实现方式 | 适用场景 | 预期效果 |

|---|---|---|---|

| 数据结构对齐 | 使用#pragma pack或align属性调整结构体内存对齐 |

高频访问的结构体或数组 | 减少内存访问次数,提升Cache利用率 |

| 循环展开 | 通过重复循环体减少循环次数,降低分支预测失败开销 | 计算密集型循环 | 提高指令级并行性,减少Cache Miss |

| 预取指令 | 使用__builtin_prefetch(&data, 0, 3)预取数据到Cache |

大数据顺序访问或可预测访问模式 | 隐藏内存访问延迟 |

| 避免伪共享 | 在多线程中,为不同线程的数据分配不同Cache行(如填充至Cache行大小) | 多线程共享数据结构 | 减少线程间Cache冲突 |

| 内存池技术 | 预分配大块内存并手动管理,减少频繁内存分配/释放带来的Cache抖动 | 动态内存操作频繁的场景 | 提升内存访问局部性 |

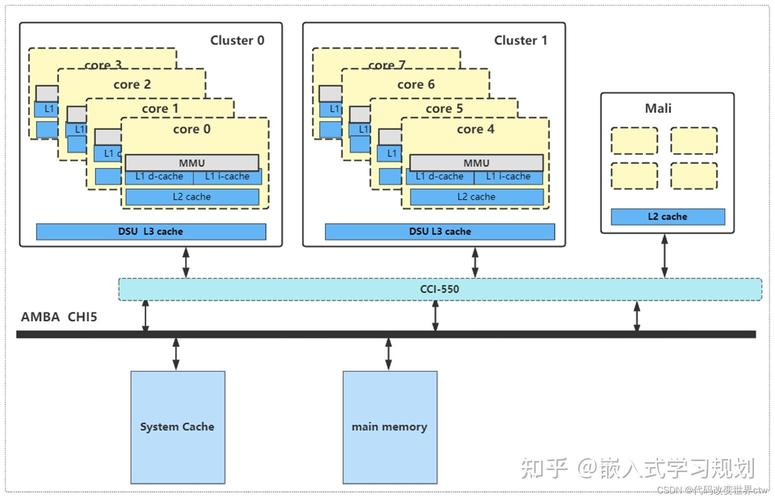

Cache技术的局限性也不容忽视,Cache容量有限,无法缓存所有数据;Cache Miss时的延迟可能成为性能瓶颈;多核处理器中,Cache一致性协议(如MESI)会增加总线开销,在C语言编程中,需结合具体硬件架构(如Cache层级、行大小)和应用程序特征(如访问模式、数据规模)进行针对性优化。

相关问答FAQs:

Q1: 如何在C语言中检测Cache命中率?

A1: 可通过性能分析工具(如perf工具链)或硬件性能计数器(如Intel的PCM库)获取Cache命中率数据,使用perf stat -e cache-misses,cache-references ./program命令可统计程序运行时的Cache Miss和References次数,命中率计算公式为(1 - cache-misses / cache-references) * 100%,也可通过模拟Cache行为(如使用Cachegrind工具)进行离线分析。

Q2: Cache抖动(Thrashing)是什么?如何避免?

A2: Cache抖动指程序访问的数据量超过Cache容量,导致频繁的Cache Miss,使Cache几乎无法命中,性能急剧下降,常见于数据密集型应用或访问模式高度随机的情况,避免方法包括:优化数据访问模式(如增加数据局部性)、增大工作集以适配Cache容量、使用分块处理(Blocking/Tiling)技术减少内存访问跨度,或通过数据压缩减少需缓存的数据量。