ar vr 使用技术:

ar(增强现实)与vr(虚拟现实)作为当前沉浸式体验的核心技术,正深刻改变着人们与数字世界的交互方式,两者的技术实现虽存在交叉,但底层逻辑和应用场景各有侧重,其核心技术涵盖硬件、软件、算法及交互等多个维度,共同构建了从虚拟到现实的桥梁。

在硬件层面,ar与vr的核心差异在于显示与感知设备的形态,vr技术依赖头戴式显示设备(HMD),通过封闭式屏幕或光学透镜将用户完全沉浸于虚拟环境中,典型设备如Oculus Quest、HTC Vive等,其硬件技术包括高分辨率显示屏(通常单眼分辨率达4K以上)、高刷新率(90Hz以上以减少眩晕感)、宽视场角(100°以上以增强沉浸感)以及精确的头部追踪传感器(如陀螺仪、加速度计、红外摄像头),而ar硬件则更强调与现实世界的融合,分为眼镜式(如Microsoft HoloLens)、手机/平板式及车载HUD式,核心技术在于光学显示方案(如光波导技术、Birdbath方案)以实现虚拟信息与真实场景的叠加,同时配备环境感知传感器(如深度摄像头、LiDAR)用于空间扫描与物体识别,两者均依赖高性能计算单元,早期vr设备需连接PC或游戏主机,而一体机vr通过集成SoC芯片(如高通骁龙XR系列)实现独立运算;ar设备则更依赖轻量化计算,部分场景需借助云端算力支持。

软件与算法层面,ar与vr的核心技术围绕“环境理解”与“交互自然化”展开,vr技术侧重虚拟场景的构建与渲染,采用游戏引擎(如Unreal Engine、Unity)进行三维建模,通过光线追踪、LOD(细节层次优化)等技术提升画面真实感,同时需要空间音频算法(如HRTF头部相关传递函数)实现声音定位与沉浸感,而ar技术的核心挑战在于“虚实融合”,其关键技术包括SLAM(同步定位与地图构建),通过传感器数据实时捕捉环境空间信息,构建三维地图并追踪设备姿态;ar还需进行平面检测(识别地面、墙面等水平/垂直面)、物体识别与追踪(如基于YOLO等算法的实时检测),以及空间锚点技术(确保虚拟物体在真实空间中的位置稳定性),在交互方面,vr依赖手柄、手势识别(如Leap Motion)或眼动追踪实现虚拟操作,而ar则更强调自然交互,如语音控制、手势识别(如MediaPipe框架)以及眼动聚焦,部分高端ar设备还支持触觉反馈(如超声波触觉阵列)。

感知与交互技术是提升ar/vr体验的关键,vr通过inside-out追踪(由头显自身传感器实现空间定位)或outside-in追踪(由基站发射信号定位)实现六自由度(6DoF)运动,而ar则需结合视觉SLAM与惯性测量单元(IMU)提升定位精度,减少环境光照变化带来的干扰,在交互反馈上,vr采用控制器振动、力反馈手套等方式模拟触感,而ar则探索“触觉反馈+空间音频”的组合方案,例如通过超声波技术在空气中聚焦力点,实现虚拟物体的“触摸”感知,眼动追踪技术(如Foveated Rendering)在vr中可通过追踪用户视线动态渲染图像中心区域,降低算力消耗;在ar中则用于实现虚拟物体的注视交互(如凝视选中)。

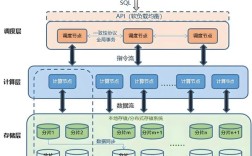

网络与算力支撑方面,ar/vr对低延迟、高带宽的需求推动了5G与边缘计算技术的发展,云渲染技术(如NVIDIA CloudXR)可将复杂计算任务转移至云端,降低终端设备负担,实现轻量化终端的vr体验;而ar的实时空间计算依赖云端SLAM与AI模型(如大型视觉语言模型)优化环境理解效率,区块链技术也被探索用于ar/vr中的数字资产确权(如虚拟土地、NFT道具),构建去中心化的虚拟经济体系。

为更直观对比ar与vr的核心技术差异,以下从硬件、软件、交互、应用场景四个维度进行总结:

| 技术维度 | ar(增强现实) | vr(虚拟现实) |

|---|---|---|

| 硬件核心 | 光学显示(光波导/Birdbath)、环境感知传感器(深度摄像头/LiDAR)、轻量化计算单元 | 封闭式HMD、高分辨率/高刷新率屏幕、6DoF追踪传感器(inside-out/outside-in)、独立SoC或PC连接 |

| 软件算法 | SLAM(同步定位与地图构建)、平面检测、物体识别、空间锚点、虚实融合渲染 | 三维场景渲染(光线追踪/LOD)、物理引擎模拟、空间音频(HRTF)、低延迟优化 |

| 交互方式 | 手势识别、语音控制、眼动追踪、触觉反馈(超声波)、与真实物体交互 | 手柄操作、手势识别、眼动凝选、力反馈设备、全身动捕(如全身追踪套件) |

| 典型场景 | 工业维修(叠加操作指引)、医疗手术(导航 overlay)、零售(虚拟试穿)、教育(立体模型展示) | 游戏、虚拟社交、沉浸式观影、模拟训练(飞行/驾驶)、虚拟旅游 |

随着技术迭代,ar与vr正呈现融合趋势(如混合现实MR),例如Apple Vision Pro通过“空间计算”实现虚拟物体与真实环境的深度交互,技术突破将聚焦于:更轻量化的光学显示(如衍射光波导)、更高精度的环境感知(AI驱动的SLAM)、更自然的交互方式(脑机接口初步探索)以及更低延迟的云边协同计算,进一步推动ar/vr从“工具”向“平台”的演进,在工业、医疗、教育、消费等领域释放更大价值。

相关问答FAQs:

Q1:ar与vr的主要技术区别是什么?

A:ar(增强现实)的核心技术是“虚实融合”,通过SLAM、光学显示等将虚拟信息叠加到真实世界,强调与现实的交互;vr(虚拟现实)则是“完全沉浸”,通过封闭式显示设备和6DoF追踪构建纯虚拟环境,侧重虚拟场景的构建与交互,硬件上,ar依赖环境感知传感器和轻量化光学方案,vr依赖高性能显示与追踪系统;软件上,ar以空间定位与物体识别为核心,vr以三维渲染与物理模拟为核心。

Q2:当前ar/vr技术面临的最大挑战是什么?

A:当前ar/vr技术面临的核心挑战包括:硬件层面,设备的轻量化与高性能平衡(如vr头显的重量与续航,ar眼镜的光学模组体积);软件层面,slam算法在动态环境中的精度不足、ar虚实融合的渲染延迟问题;交互层面,自然交互的拟真度有限(如触觉反馈的细腻度不足);内容生态的丰富度与用户习惯的培养也是制约普及的关键因素,未来需通过材料创新(如MicroLED显示)、AI算法优化(如实时动态slam)及跨平台标准统一(如OpenXR)逐步突破。